A Fondo

Mistral AI: todas las novedades del modelo que se atreve con todo y cumple con Europa

En lo que respecta a novedades en IA nos hemos acostumbrado a que las noticias nos lleguen desde EEUU o China, pero las cosas no siempre son así. La soberanía europea en inteligencia artificial ha dejado de ser una aspiración política para convertirse en una variable de decisión operativa. El EU AI Act, plenamente aplicable desde agosto de 2026 para sistemas de alto riesgo, obliga a las organizaciones a demostrar trazabilidad, transparencia y control efectivo sobre los modelos que despliegan, tres requisitos que las APIs externas de proveedores americanos satisfacen de forma parcial y siempre condicionada a sus propios términos de uso. A esa presión regulatoria se suma el Reglamento de Datos europeo (Data Act), en vigor desde septiembre de 2025, que establece obligaciones de portabilidad e interoperabilidad que colisionan frontalmente con los modelos de retención de datos de los grandes hiperescalares.

En ese contexto, la aparición de AMI Labs, la startup de Yann LeCun respaldada con más de mil millones de dólares y orientada a eliminar las alucinaciones mediante una arquitectura radicalmente diferente a los grandes modelos de lenguaje convencionales, no es una anécdota de laboratorio: es la segunda señal en menos de tres años de que Europa está construyendo una alternativa real de frontera. La primera se llama Mistral AI, y esta semana ha ejecutado uno de los despliegues de producto más densos de su historia.

Entre el 16 y el 17 de marzo de 2026, coincidiendo con la conferencia NVIDIA GTC 2026 en San José, Mistral AI publicó cuatro anuncios con implicaciones directas para cualquier organización que esté definiendo su estrategia de IA empresarial este año. No son actualizaciones incrementales: cada uno ataca un problema estructural diferente que hasta ahora frenaba la adopción de IA en entornos corporativos regulados.

Forge: el fin del AI genérico

Forge elimina el principal argumento contra la IA empresarial: que los modelos generales no entienden el contexto interno de cada organización. Construir un modelo especializado de nivel frontera pasa de ser una dependencia perpetua de proveedores a una inversión de capital con retorno medible y conocimiento que permanece bajo control propio. El lanzamiento oficial de Mistral Forge es, posiblemente, el anuncio más relevante para los departamentos de IT en lo que va de año. Forge permite a empresas y gobiernos construir modelos de IA de nivel frontera (es decir, de máxima capacidad competitiva, comparable a los mejores modelos del mercado) entrenados exclusivamente sobre su conocimiento propietario: documentación técnica, normativas internas, bases de código, procesos operativos y decisiones institucionales acumuladas durante años.

La diferencia con el ajuste fino convencional (que consiste en personalizar superficialmente un modelo genérico con datos propios) es estructural. Forge soporta el ciclo completo de entrenamiento: preentrenamiento sobre grandes repositorios internos, post-entrenamiento mediante técnicas avanzadas de alineación como DPO (Direct Preference Optimization) y ODPO, y pipelines de aprendizaje por refuerzo que adaptan el comportamiento del modelo a las políticas y criterios operativos de cada organización. El modelo resultante no vive en los servidores de Mistral: permanece dentro del perímetro de control del cliente, lo que convierte el cumplimiento bajo GDPR, DORA y el EU AI Act en una consecuencia arquitectónica, no en una cláusula contractual.

Los socios de lanzamiento confirman la orientación estratégica: ASML, Ericsson, la Agencia Espacial Europea (ESA), los laboratorios de defensa de Singapur (DSO) y la consultora Reply. Son organizaciones con datos de altísimo valor específico de dominio, para las que ningún modelo entrenado en texto de internet puede sustituir décadas de conocimiento institucional. El modelo de servicio de Forge incluye ingenieros de Mistral integrados en los equipos del cliente, un enfoque operativo similar al de IBM o Palantir que reduce drásticamente el tiempo hasta la puesta en producción (Time-to-Market) de sistemas de IA especializados.

Leanstral: código sin zonas grises

Cuando el 42% del código en producción ya es generado por IA, la verificación formal deja de ser una práctica de nicho para convertirse en un mecanismo de gestión de riesgo operativo. Leanstral lo hace accesible a un coste hasta 92 veces inferior al de las alternativas de mercado, eliminando la deuda técnica derivada de código de IA no verificado antes de que se acumule en sistemas críticos.

El 16 de marzo, Mistral publicó Leanstral, el primer agente de código abierto diseñado específicamente para Lean 4, el asistente de demostración de teoremas utilizado por Google DeepMind (AlphaProof) y Amazon (Cedar, su sistema de verificación de políticas de autorización). El problema que resuelve es crítico: los modelos de lenguaje generan código que parece correcto pero falla en condiciones reales. La verificación formal, a diferencia de los tests unitarios convencionales, demuestra matemáticamente que el código cumple exactamente su especificación. No hay zona gris: la prueba compila, o no compila.

Con una arquitectura Mixture-of-Experts de 120.000 millones de parámetros totales pero solo 6.500 millones activos por inferencia, Leanstral supera en el benchmark FLTEval a modelos de código abierto con hasta seis veces más parámetros activos, y ofrece rendimiento superior al de modelos comerciales de referencia a un coste de ejecución 15 veces inferior. Se distribuye bajo licencia Apache 2.0: puede ser auditado, modificado y desplegado en infraestructura propia sin restricciones comerciales. Para sectores regulados por el EU AI Act, que exige trazabilidad del código producido por sistemas de IA, la verificación formal pasa de ser un lujo a ser un mecanismo de cumplimiento.

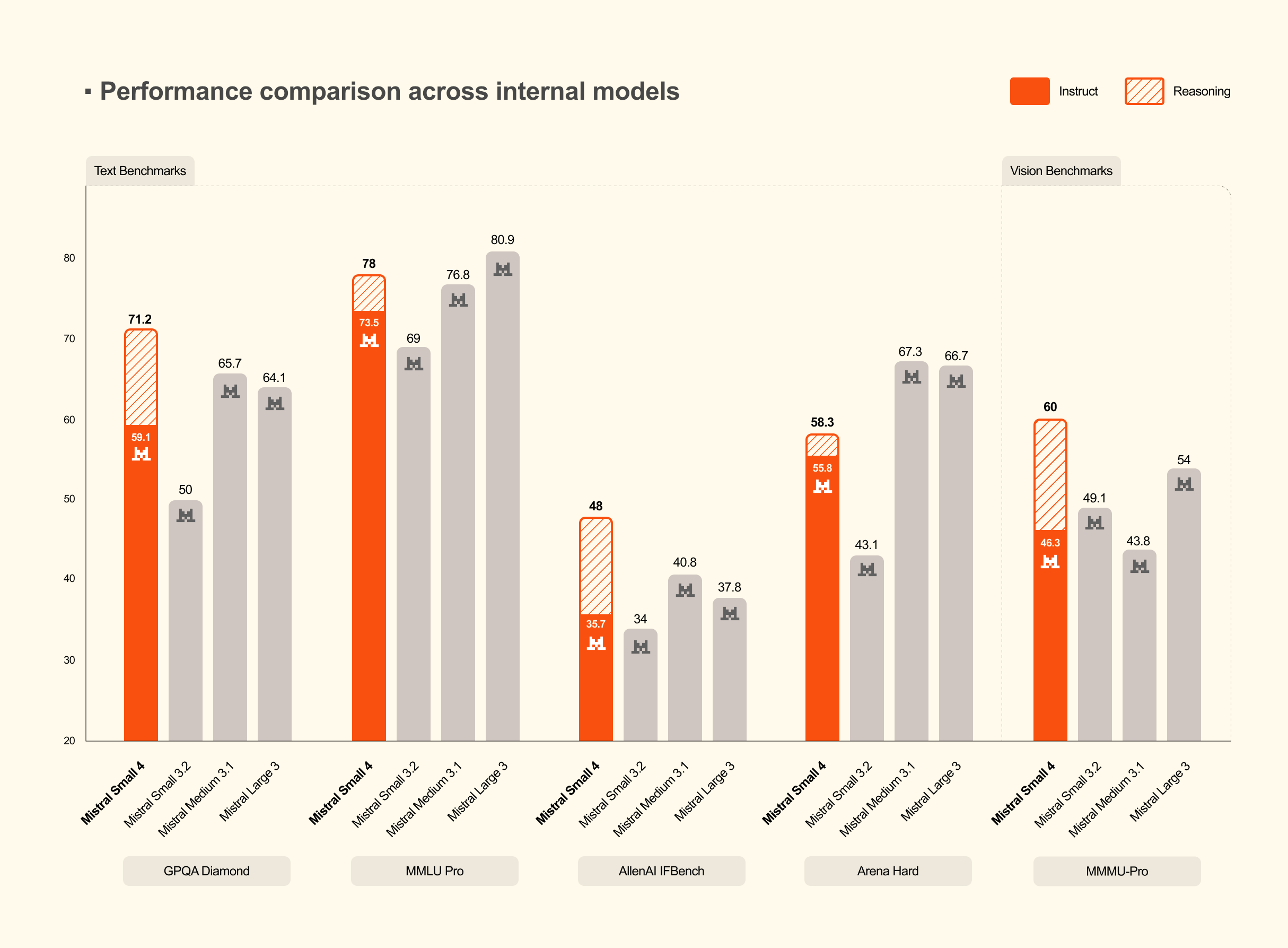

Small 4: un modelo, todo incluido

Mistral Small 4 resuelve un problema operativo real en los departamentos de IT: la proliferación de modelos especializados obliga a mantener múltiples pipelines, con el coste de infraestructura y gestión que eso implica. Un único modelo que razona, procesa imágenes y genera código de agente reduce ese coste estructural de forma inmediata y sin sacrificar rendimiento de frontera.

El 16 de marzo, coincidiendo con su incorporación como miembro fundador de la Nemotron Coalition, Mistral lanzó Mistral Small 4, el primer modelo de la compañía que unifica en una sola arquitectura las capacidades de sus tres modelos especializados anteriores: Magistral (razonamiento complejo), Pixtral (análisis de imágenes y documentos visuales) y Devstral (programación agéntica). El resultado es un modelo con 119.000 millones de parámetros totales pero solo 6.000 millones activos por inferencia gracias a su arquitectura Mixture-of-Experts de 128 expertos, lo que permite desplegarlo con una infraestructura mínima de cuatro servidores NVIDIA HGX H100, una barrera de entrada muy inferior a la de modelos de capacidad comparable. La ventana de contexto de 256.000 tokens (es decir, la cantidad de texto que el modelo puede procesar de una vez, equivalente a varios libros completos) lo hace especialmente adecuado para análisis de documentación técnica extensa o bases de código completas.

El dato de rendimiento más relevante para quienes evalúan el coste de operación no es el porcentaje de acierto en benchmarks académicos, sino la eficiencia: Mistral Small 4 iguala o supera a modelos comerciales de referencia con hasta un 75% menos de texto generado por respuesta. Menos tokens producidos significa menor latencia, menor coste por inferencia y mejor experiencia de usuario final. Se distribuye bajo licencia Apache 2.0 y es compatible con los principales frameworks de despliegue abierto: vLLM, llama.cpp, SGLang y Transformers.

OCR 3: datos sin silos

Aproximadamente el 90% de los datos corporativos sigue almacenado en documentos no estructurados. Mistral OCR 3 convierte ese repositorio en conocimiento procesable por sistemas de IA, con una tasa de mejora del 74% sobre su versión anterior y a un precio que cambia radicalmente el análisis de retorno de inversión de cualquier proyecto de automatización documental. Mistral OCR 3 es la tecnología que convierte imágenes de documentos (facturas, expedientes, formularios, informes técnicos escaneados) en texto directamente procesable por sistemas de IA. La versión 3 mejora de forma sustancial cuatro áreas operativas críticas: escritura manuscrita, formularios complejos, documentos escaneados de baja calidad y tablas con celdas combinadas.

La arquitectura genera salidas en formato Markdown con etiquetas estructuradas para tablas, lo que permite su integración directa con sistemas de recuperación aumentada de información (RAG, es decir, sistemas que combinan búsqueda en documentos propios con capacidades de lenguaje de la IA) sin etapas intermedias de limpieza de datos. El precio, dos dólares por cada mil páginas procesadas (con descuento del 50% para procesamiento por lotes), posiciona a OCR 3 como la alternativa de menor coste total frente a soluciones empresariales consolidadas como ABBYY FineReader, Google Document AI o Amazon Textract. Para organizaciones que gestionan acervos documentales históricos o flujos de cumplimiento regulatorio, OCR 3 es el punto de entrada más eficiente hacia una arquitectura de IA construida sobre conocimiento propio.

Nemotron: el estándar abierto

Ahora vamos con un anuncio con un nombre digno de saga de ciencia ficción. La participación de Mistral como codesarrollador principal de la Nemotron Coalition no es una alianza de marketing: es un movimiento que posiciona a la empresa francesa como arquitecta del estándar de modelos abiertos de frontera para la próxima generación de infraestructura de IA empresarial global, con implicaciones directas sobre los costes de adopción tecnológica de los próximos tres años.

El 16 de marzo, NVIDIA anunció en GTC la Nemotron Coalition, una alianza de laboratorios de IA líderes (Black Forest Labs, Cursor, LangChain, Perplexity, Reflection AI, Sarvam y Thinking Machines Lab, fundada por la ex-CTO de OpenAI Mira Murati) con el objetivo de codesarrollar modelos de frontera de código abierto sobre infraestructura NVIDIA DGX Cloud. El primer proyecto será un modelo base codesarrollado específicamente por Mistral AI y NVIDIA, que servirá como fundamento de la próxima familia NVIDIA Nemotron 4.

La implicación estratégica es directa: si los modelos de frontera del próximo ciclo tecnológico tienen arquitectura codesarrollada por Mistral, las organizaciones que hayan construido sus pipelines de IA sobre los modelos y herramientas de Mistral partirán con ventaja en la adopción de los nuevos estándares abiertos, sin coste de migración ni dependencia de un proveedor único. Como declaró el CEO Arthur Mensch en el comunicado oficial: los modelos de frontera abiertos son cómo la IA se convierte en una plataforma real, y Mistral tomará un papel protagonista en ese proceso.

Prescindiendo de cualquier argumento regulatorio o de soberanía, los cinco anuncios de esta semana retratan a una empresa que ha resuelto el problema que más daño hace a los grandes laboratorios americanos y chinos: la especialización a escala. OpenAI, Google DeepMind y Anthropic compiten en la cima del rendimiento general, pero ninguno ofrece a sus clientes empresariales la capacidad de construir un modelo de frontera sobre conocimiento propio sin ceder ese conocimiento al proveedor. DeepSeek ha demostrado que la eficiencia arquitectónica puede competir con el gasto masivo en computación, pero opera bajo restricciones de confianza que limitan su adopción en sectores críticos occidentales.

Mistral ocupa ese espacio intermedio con una propuesta que ninguno de sus competidores puede replicar sin contradecir su modelo de negocio: modelos de frontera, abiertos, codesarrollados con el mayor fabricante de hardware de IA del mundo, desplegables en infraestructura propia y combinados con un servicio de entrenamiento sobre datos propietarios que convierte el conocimiento institucional de cada cliente en una ventaja competitiva que ningún tercero puede copiar, auditar ni revocar. En el mercado de IA empresarial, eso no es una propuesta diferenciada, es una categoría nueva.

Qué es Mistral AI

Mistral AI fue fundada en abril de 2023 en París por tres investigadores de primer nivel: Arthur Mensch (CEO, ex Google DeepMind), Guillaume Lample (Chief Scientist, ex Meta AI) y Timothée Lacroix (CTO, ex Meta AI). En menos de tres años han construido una empresa valorada en 14.000 millones de dólares, con inversores como Andreessen Horowitz, ASML, NVIDIA, Microsoft y Salesforce, y clientes activos en defensa, banca, aeroespacial y tecnología industrial. Es el unicornio tecnológico de mayor crecimiento en la historia de Europa, y su propuesta central, modelos de pesos abiertos (open-weight) que las organizaciones pueden ejecutar, auditar y modificar en su propia infraestructura, es la respuesta estructural más sólida que existe hoy al problema de la dependencia tecnológica de hiperscalers americanos bajo el marco regulatorio europeo. Puedes seguir toda la cobertura de la empresa en los artículos sobre Mistral AI en MuyComputerPRO.

Los cinco anuncios de esta semana son lo suficientemente importantes como para tenerlos en cuenta en una estrategia de Inteligencia Artificial con vistas al futuro, sobre todo en lo que respecta el cumplimiento de las estrictas normativas europeas que hemos mencionado. El primer paso y quizás el más disruptivo e interesante es evaluar Mistral Forge como plataforma para construir un modelo especializado sobre conocimiento propietario, identificando el área de negocio con mayor concentración de datos internos no explotados.

El segundo ya depende de la dependencia de procesos documentales para valorar la incorporación Mistral OCR 3 en el pipeline de digitalización documental, priorizando los repositorios que alimentarán sistemas RAG para eliminar los silos de datos que lastran la eficiencia operativa. El tercero es valorar Mistral Small 4 como modelo de uso general para los equipos que hoy mantienen varios modelos especializados en paralelo: su arquitectura unificada de razonamiento, visión y código reduce el coste operativo de infraestructura sin sacrificar capacidad de frontera. El cuarto es intrigante para empresas con alto volumen de desarrollo propio, especialmente urgente para equipos que ya producen código con IA. Merece la pena iniciar una evaluación piloto de Leanstral en módulos críticos, particularmente en entornos donde el EU AI Act exige trazabilidad del código generado automáticamente.

Finalmente, el posicionamiento de Mistral como codesarrollador de la Nemotron Coalition justifica por sí solo abrir conversaciones con su equipo comercial antes de que la familia Nemotron 4 esté disponible en producción: las organizaciones que construyan sus pipelines sobre arquitectura compatible partirán con una ventaja de adopción medible y sin coste de migración. No creemos que Mistral AI pueda llegar a competir en fuerza bruta (financiera, de infraestructura…) con los grandes jugadores en el campo de la Inteligencia Artificial, pero con su planteamiento único optimizado y específico para empresas y la gran ventaja de facilitar el cumplimiento de normativas europeas como mínimo merece una oportunidad en grandes proyectos.

-

NoticiasHace 4 días

NoticiasHace 4 díasTelefónica España se alía con Sateliot para llevar comunicación 5G por satélite a sectores estratégicos

-

EntrevistasHace 3 días

EntrevistasHace 3 días«La mejor forma de acelerar la IA no es mover más datos, es llevar la IA allá donde están»

-

NoticiasHace 4 días

NoticiasHace 4 díasEl crecimiento del IoT obliga a reforzar la supervisión continua en los pagos digitales

-

NoticiasHace 3 días

NoticiasHace 3 díasSAP compra Dremio y Prior Labs para mejorar sus capacidades de IA