A Fondo

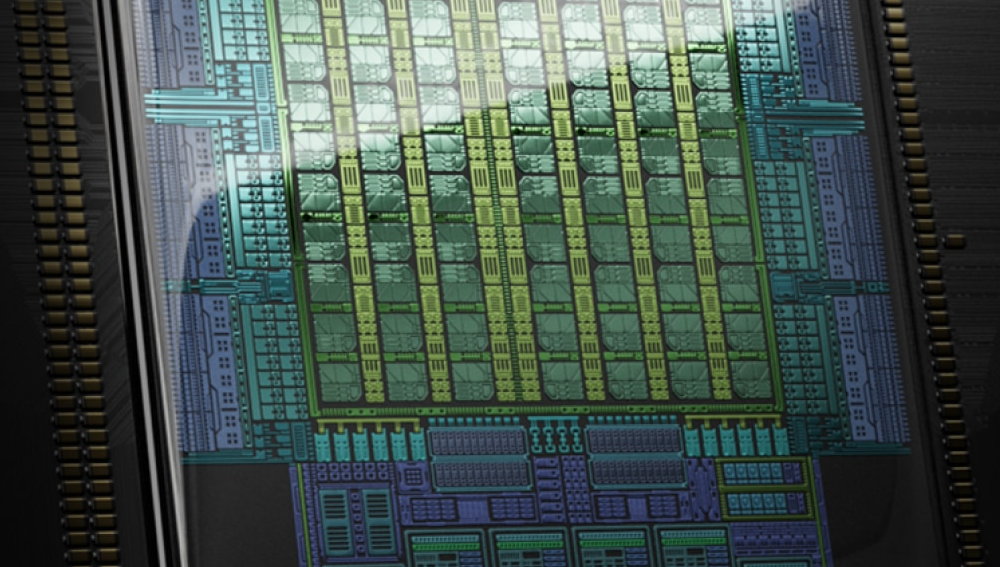

NVIDIA Rubin estrena las nuevas plataformas de IA

NVIDIA ha aprovechado el marco del CES para iniciar el despliegue de NVIDIA Rubin, su nueva plataforma de computación para IA. Según el gigante verde, se trata de «un nuevo estándar para construir, implementar y proteger los sistemas de IA más grandes y avanzados del mundo al menor coste para acelerar la adopción generalizada de inteligencia artificial».

NVIDIA ha pasado por la feria de Las Vegas con varias novedades, como el lanzamiento del DLSS 4.5 Super Resolution y la generación múltiple de fotogramas. También ha anunciado soporte completo y nativo del GeForce Now para Linux, ambos anuncios importantes para los videojuegos en PC. Por supuesto, teniendo en cuenta que sus soluciones de hardware para IA lo han llevado a cifras multimillonarias de ingresos y beneficios, no han faltado novedades en este apartado y la principal es que la que vamos a comentar.

NVIDIA Rubin, despliege

La plataforma Rubin utiliza un diseño de código extremo en los seis chips que la forman (la CPU NVIDIA Vera , la GPU NVIDIA Rubin, el conmutador NVIDIA NVLink 6 , el SuperNIC NVIDIA ConnectX-9 , la DPU NVIDIA BlueField-4 y el conmutador Ethernet NVIDIA Spectrum 6 ) para reducir drásticamente el tiempo de entrenamiento y los costos de los tokens de inferencia como explica Jensen Huang, fundador y CEO de NVIDIA:

«Rubin llega en el momento justo, ya que la demanda de computación de IA, tanto para entrenamiento como para inferencia, está en alza… Con nuestra cadencia anual de entrega de una nueva generación de supercomputadoras de IA, y un diseño de código extremo en seis nuevos chips, Rubin da un gran paso hacia la próxima frontera de la IA”.

La plataforma Rubin, que lleva el nombre de Vera Florence Cooper Rubin, la pionera astrónoma estadounidense cuyos descubrimientos transformaron la comprensión de la humanidad sobre el universo, incluye la solución a escala de rack NVIDIA Vera Rubin NVL72 y el sistema NVIDIA HGX Rubin NVL8.

La plataforma Rubin presenta innovaciones, entre ellas las últimas generaciones de la tecnología de interconexión NVIDIA NVLink, Transformer Engine, Confidential Computing y RAS Engine, así como la CPU NVIDIA Vera. Estos avances acelerarán la IA agentica, el razonamiento avanzado y la inferencia de modelos de mezcla de expertos (MoE) a gran escala con un coste por token hasta 10 veces menor que el de la plataforma NVIDIA Blackwell. En comparación con su predecesora, la plataforma NVIDIA Rubin entrena modelos MoE con 4 veces menos GPU para acelerar la adopción de la IA, según los datos de la compañía.

Inteligencia escalable

La IA agencial y los modelos de razonamiento, junto con las cargas de trabajo de generación de vídeo de vanguardia, están redefiniendo los límites de la computación. La resolución de problemas en varios pasos requiere que los modelos procesen, razonen y actúen en largas secuencias de tokens, describen desde NVIDIA. Diseñadas para satisfacer las demandas de cargas de trabajo de IA complejas, las cinco tecnologías innovadoras de la plataforma Rubin incluyen:

– NVIDIA NVLink de sexta generación: Ofrece la comunicación rápida y fluida entre GPU, necesaria para los modelos MoE masivos actuales. Cada GPU ofrece 3,6 TB/s de ancho de banda, mientras que el rack Vera Rubin NVL72 proporciona 260 TB/s, más ancho de banda que todo Internet. Con computación integrada en red para acelerar las operaciones colectivas, así como nuevas funciones para mejorar la capacidad de servicio y la resiliencia, el switch NVLink 6 permite un entrenamiento e inferencia de IA más rápidos y eficientes a escala.

– CPU NVIDIA Vera: Diseñada para el razonamiento agente, NVIDIA Vera es la CPU con mayor eficiencia energética para fábricas de IA a gran escala. La CPU NVIDIA está construida con 88 núcleos Olympus personalizados de NVIDIA, compatibilidad total con ARMv9.2 y conectividad NVLink-C2C ultrarrápida. Vera promete un gran rendimiento, ancho de banda y una eficiencia líder en el sector para soportar una amplia gama de cargas de trabajo en centros de datos modernos.

– GPU NVIDIA Rubin: con un motor Transformer de tercera generación con compresión adaptativa acelerada por hardware, la GPU Rubin ofrece 50 petaflops de procesamiento NVFP4 para inferencia de IA.

– Computación confidencial NVIDIA de tercera generación: Vera Rubin NVL72 es la primera plataforma a escala de rack que ofrece Computación confidencial NVIDIA , que mantiene la seguridad de los datos en los dominios de CPU, GPU y NVLink, protegiendo los modelos propietarios más grandes del mundo, las cargas de trabajo de entrenamiento e inferencia.

– Motor RAS de segunda generación: La plataforma Rubin, que abarca GPU, CPU y NVLink, ofrece comprobaciones de estado en tiempo real, tolerancia a fallos y mantenimiento proactivo para maximizar la productividad del sistema. El diseño modular de bandejas sin cables del rack permite un montaje y mantenimiento hasta 18 veces más rápidos que los de Blackwell.

Amplio soporte del ecosistema

La plataforma tendrá un amplio respaldo y entre los principales laboratorios de inteligencia artificial, proveedores de servicios en la nube, fabricantes de computadoras y nuevas empresas del mundo que se espera que adopten NVIDIA Rubin se encuentran Amazon Web Services (AWS), Anthropic, Black Forest Labs, Cisco, Cohere, CoreWeave, Cursor, Dell Technologies , Google, Harvey, HPE, Lambda, Lenovo, Meta, Microsoft, Mistral AI, Nebius, Nscale, OpenAI, OpenEvidence, Oracle Cloud Infrastructure (OCI), Perplexity, Runway, Supermicro , Thinking Machines Lab y xAI.

NVIDIA Rubin está en fase de producción y los productos basados en la plataforma estarán disponibles a través del amplio ecosistema de socios de la compañía en el segundo semestre de 2026.

-

A FondoHace 4 días

A FondoHace 4 díasIntel lanza los Xeon 6+ y presenta los primeros detalles de Xeon 7

-

NoticiasHace 5 días

NoticiasHace 5 díasLa suite europea Euro-Office estará disponible el 9 de junio

-

NoticiasHace 4 días

NoticiasHace 4 díasSalesforce compra la compañía alemana de gestión de contenidos Contentful

-

A FondoHace 2 días

A FondoHace 2 díasLa UE presenta por fin sus planes para despegar en soberanía tecnológica