Noticias

NVIDIA se lanza a la IA agéntica con la CPU Vera y la plataforma Vera Rubin

NVIDIA ha mostrado en el GTC 2026 que apuesta en firme por la IA agéntica con el lanzamiento de distintos componentes y plataformas hardware pensadas para desplegar y trabajar con agentes. Es el caso de la CPU NVIDIA Vera y de la plataforma Vera Rubin.

La primera es el primer procesador diseñado específicamente para trabajar en IA agéntica y aprendizaje por refuerzo. Ofrece resultados que, según los cálculos de NVIDIA, son un 50% más rápidos que los obtenidos por las CPUs tradicionales a escala de rack.

Combina núcleos de CPU de alto rendimiento y eficiencia energética, un subsistema de memoria con un ancho de banda elevada y la segunda generación de NVIDIA Scalable Coherency Fabric. Esto agiliza las respuestas agéntiocas en condiciones de uso extremo habituales en IA agéntica y aprendizaje por refuerzo.

Vera cuenta con 88 nucleos Olympus diseñados a medida, que ofrercen un rendimiento elevado para compiladores, motores de tiempo de ejecución, canalizaciones de análisis, herramientas de agente y servicios de orquestación. Cada núcleo puede ejecutar dos tareas, empleando NVIDIA Spatial Multithreading para ofrecer un rendimiento constante y predecible, lo que necesitan las fábricas de IA multitenant que ejecutan muchas tareas al mismo tiempo.

Por otro lado, Vera cuenta con la segunda generación del subsistema de memoria de bajo consumo de la compañía, ahora basado en memoria LPDDR5X, que ofrece hasta 1,2 TB/s de ancho de banda y permite mejorar la eficiencia energética.

La CPU NVIDIA Vera permite a empresas y entidades de cualquier tamaño y sector crear fábricas de IA para trabajar con IA agéntica. Entre los principales hiperescalares que colaboran con NVIDIA para la implementación de Vera están Alibaba, CoreWeave, Meta y Oracle Cloud Infrastructure, así como fabricantes de sistemas como Dell, HPE, Lenovo o Supermicro.

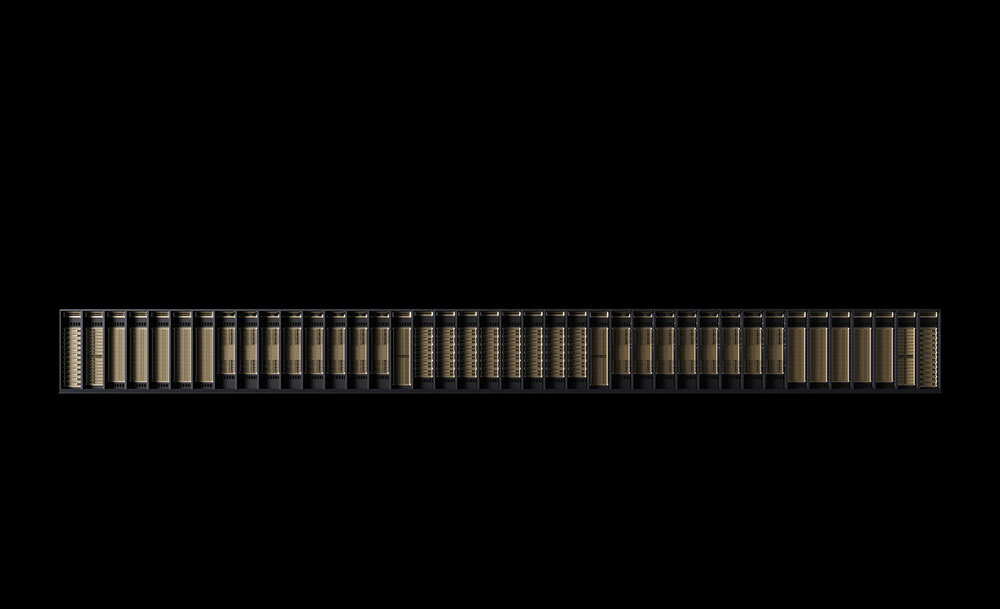

Con Vera como base, NVIDIA ha anunciado un nuevo rack de CPU Vera que integra 256 CPUs Vera refrigeradas por líquido para soportar más de 22.500 entornos de CPU simultáneos. Cada uno de ellos es capaz de funcionar a pleno rendimiento de manera independiente. Las fábricas de IA pueden desplegarse y escalar hasta alcanzar decenas de miles de instancias simultáneas y herramientas autónomas en un solo rack.

El rack Vera se ha desarrollado con la arquitectura de referencia modular NVIDIA MGX. En cuanto a las CPU Vera, se combinan con las GPU de NVIDIA a través de la tecnología de interconexión NVIDIA NVLink-C2C, con un ancho de banda coherente de 1,8 TB/s que permiten un intercambio de datos a alta velocidad entre CPU y GPU.

NVIDIA ha presentado también varios diseños de referencia que emplean Vera como CPU host para los sistemas NVIDIA HGX Rubin NVL8, coordinando el movimiento de datos y el control del sistema para cargas de trabajo aceleradas por GPU. En todas las configuraciones de servidores con CPU de doble y un solo zócalo que ya ofrecen los partners de sistemas Vera, integran tarjetas NVIDIA ConnectX SuperNIC y DPU NVIDIA BlueField 4 para acelerar redes, almacenamiento y seguridad; lo que resulta crítico para la IA agéntica.

NVIDIA Vera Rubin, una plataforma con siete chips para factorías de IA

Otra de las principales novedades de NVIDIA en el GTC 2026 es la plataforma Vera Rubin, con siete chips que ya están en producción, y que tiene como objetivo ampliar y aportar más potencia a las fábricas de IA. La plataforma combina la CPU Vera, la GPU Rubin, el switch NVLink 6, la SuperNIC ConnectX-9, la DPU BlueField-4 y el switch Ethernet Spectrum-6, así como la LPU NVIDIA Groq3.

Estos chips que se diseñaron para poder funcionar de manera conjunta, impulsan todas las fases de la IA, desde el preentrenamiento a gran escala hasta el postentrenamiento y el escalado en tiempo de prueba, pasando por la inferencia agéntica en tiempo real.

El rack NVIDIA Vera Rubin NVL72 integra 72 GPU Rubin y 36 CPU Vera conectadas mediante NVLink 6, con SuperNIC ConnectX-9 y DPU BlueField-4, permite entrenar modelos grandes de mezcla de expertos con la cuarta parte de GPUs que la plataforma NVIDIA Blackwell. Además, consigue un rendimiento de inferencia hasta 10 veces mayor por vatio. Todo con una décima parte del coste por token.

Está diseñado para fábricas de IA a hiperescala, y se puede sumar a NVIDIA Quantum-X800 InfiniBand y Spectrum-X Ethernet para mantener un uso elevado en clústeres masivos de GPU, además de reducir el tiempo de entrenamiento y el coste de propiedad.

El rack de CPU NVIDIA Vera, por su parte, ofrece una infraestructura densa y refrigerada por líquido basada en NVIDIA MGX, que integra 256 GPU Vera para ofrecer capacidad escalable y eficiente en cuanto a energía, con un rendimiento de un solo subproceso de primer nivel, lo que permite desarrollar IA agéntica a gran escala.

Los racks de CPU Vera, integrados con la red Ethernet Spectrum-X, se encargan de mantener los entornos de CPUs sincronizados en toda la fábrica de IA. Con los racks de computación de GPU, ofrecen la base de CPU para la IA agéntica y el aprendizaje por refuerzo a gran escala.

El rack NVIDIA Groq 3 LPX, por su parte, está diseñado para las exigencias de baja latencia y contexto amplio de los sistemas agénticos. LPX y Vera Rubin unen el rendimiento de ambos procesadores para ofrecer un rendimiento de inferencia hasta 35 veces mayr por megavatio. El rack LPX con 256 procesadores LPU ceunta con 128 GB de SRAM integrada y 640 TB/s de ancho de banda escalable. Implementadas con Vera Rubin NVL72, las GPU y LPU Rubin potencian la decodificación al calcular de forma conjunta cada capa del modelo de IA para cada token de salida.

La arquitectura LPX está optimizada para modelos de billones de parámetros y contextos de millones de token, y se combina con Vera Rubin para aumentar la eficiencia en potencia, memoria y computación. LPX, cuenta con una refrigeración completamente líquida y está constribuido sobre la infraestructura MGX, y se integra con facilidad en las fábricas de IA Vera Rubin de próxima generación, que estarán disponibles en la segunda mitad de 2026.

El sistema a escala de rack NVIDIA BlueField-4STX es una infraestructura de almacenamiento nativa de IA que amplía la memoria de la GPU a través del POD. Impulsado por BlueField-4, que combina la CPU NVIDIA Vera y la SuperNIC NVIDIA ConnectX-9, STX ofrece una capa compartida, con ancho de banda elevado, para almacenar y recuperar los datos de caché clave-calor generados por LLM y flujos de trabajo de IA agéntica.

NVIDIA DOCA Memos, un nuevo marco DOCA que impulsa el almacenamiento BlueField-4, permite un proceso de almacenamiento de caché KV dedicado para multiplicar por cinco el rendimiento de la inferencia, además de mejorar la eficiencia energética de las arquitecturas de almacenamiento de uso general. El resultado es un contexto a nivel de POD que ofrece interacciones multiturno más rápidas con agentes de IA, servicios de IA más escalables y más uso general de la infraestructura.

El rack Ethernet NVIDIA Spectrum-6 SPX Ethernet está diseñado para acelerar el tráfico este-oeste en las fábricas de IA. Configurable con switches Spectrum-X Ethernet o NVIDIA Quantum-X8000 InfiniBand, ofrece conectividad de rack a gran escala con baja latencia y rendimiento elevado.

NVIDIA ha lanzado además con más de 200 partners de infraestructura de centros de datos la plataforma DSX para Vera Rubin. Esta incluye DSX Max-! para permitir el aprovisionamiento dinámico de energía en toda la fábrica de IA. Por otro lado, el nuevo software DSX Flex permite que las fábricas de IA sean activos flexibles en la red eléctrica gracias a la liberación de 100 gigavatios de energía de la red.

Hoy también ha visto la luz el diseño de referencia de la fábrica de IA Vera Rubin DSX, un modelo de infraestructura de IA codiseñada que maximia los tokens por vatio y el rendimiento global. Integra de forma estrecha computación, redes, almacenamiento, alimentación y refrigeración, por lo que mejora la eficiencia energética y facilita que las fábricas de IA escalen de manera fiable con cargas de trabajo continuas y de alta intensidad con el máximo tiempo de actividad.

Los productos basados en Vera Rubin estarán disponibles a partir de partners desde la segunda mitad de 2026. Entre ellos están los principales proveedores cloud (AWS, Google Cloud, Azure y Oracle Cloud Infrastructure) y distintos partners de NVIDIA Cloud: CoreWeave, Crusoe, Lambda, Nebiud, Nscal y Together AI. Todo apunta además a que Cisco, Dell HPE, Lenovo o Supermicro ofrecerán servidores basados en Vera Rubin.

-

EntrevistasHace 3 días

EntrevistasHace 3 días«El accesorio ha dejado de ser el relleno del pedido para convertirse en una categoría estratégica»

-

NoticiasHace 4 días

NoticiasHace 4 díasEl 78% de empresas del sector tecnológico en España no consigue cubrir sus vacantes

-

NoticiasHace 3 días

NoticiasHace 3 díasGitHub Copilot pasará a un modelo de pago por uso a partir del 1 de junio

-

NoticiasHace 3 días

NoticiasHace 3 díasOpenAI termina su acuerdo de exclusividad con Microsoft y abre la puerta a acuerdos con Google y AWS