Noticias

El MCP de Anthropic ¿Quién se responsabiliza de la IA y del riesgo para 200.000 servidores?

El MCP de Anthropic, el protocolo abierto que a modo de ‘traductor universal’ estandariza cómo los modelos de IA se conectan a datos y herramientas externas, está en el ojo del huracán. Mientras que investigadores de seguridad hablan de «un fallo de diseño que pone en riesgo a 200.000 servidores» la compañía lo descarta e insiste en que su comportamiento «es el esperado».

El equipo de investigación de Ox afirma haber solicitado repetidamente a Anthropic que solucionara el problema de raíz, y que se les respondió una y otra vez que el protocolo funcionaba perfectamente, a pesar de las 10 vulnerabilidades CVE descubiertas hasta el momento de gravedad alta y crítica detectadas en herramientas de código abierto y agentes de IA que utilizan MCP. Según Ox, una solución para el problema de raíz podría haber reducido el riesgo en paquetes de software con más de 150 millones de descargas y protegido a millones de usuarios.

Anthropic «se negó a modificar la arquitectura del protocolo, alegando que el comportamiento era el previsible«, aseguran los investigadores de Ox en un blog sobre su investigación, que comenzó en noviembre de 2025 e incluyó más de 30 procesos de divulgación responsable. Una semana después de emitir el informe inicial a Anthropic, el proveedor de IA publicó discretamente una política de seguridad actualizada, como suele ocurrir cuando se trata de fallos de IA . La guía actualizada indica que los adaptadores MCP, en concreto los STDIO, deben usarse con precaución, según escribió el equipo.

El MCP de Anthropic

Según los expertos en seguridad, el problema principal reside en MCP, un protocolo de código abierto desarrollado originalmente por Anthropic que utilizan los sistemas de aprendizaje automático, las aplicaciones de IA y los agentes para conectarse a datos externos, sistemas y entre sí. Funciona en diversos lenguajes de programación, lo que significa que cualquier desarrollador que utilice el kit de desarrollo de software oficial de MCP de Anthropic en cualquiera de los lenguajes compatibles, incluidos Python, TypeScript, Java y Rust, hereda esta vulnerabilidad.

MCP utiliza STDIO (entrada/salida estándar) como mecanismo de transporte local para que una aplicación de IA genere un servidor MCP como subproceso. «Pero en la práctica, permite que cualquiera ejecute cualquier comando arbitrario del sistema operativo; si el comando crea correctamente un servidor STDIO, devolverá el identificador, pero si se le da un comando diferente, devuelve un error después de que se ejecuta el comando», escribieron los investigadores de Ox.

El abuso de esta lógica puede dar lugar a cuatro tipos diferentes de vulnerabilidades, RCE como principal o la inyección de comandos autenticados y no autenticados, que permiten a un atacante introducir comandos controlados por el usuario que se ejecutarán directamente en el servidor sin autenticación ni validación. Esto puede provocar el compromiso total del sistema, y ??cualquier marco de IA con una interfaz de usuario pública es vulnerable, aseguran los investigadores.

Ox argumenta que Anthropic tiene la capacidad y la responsabilidad de garantizar la seguridad de MCP por defecto. «Un solo cambio arquitectónico a nivel de protocolo habría protegido a todos los proyectos posteriores, a todos los desarrolladores y a todos los usuarios finales que dependen de MCP hoy en día», escriben.

Responsabilidad de la IA

Los problemas con el MCP de Anthropic vuelven a traer sobre el tapete la responsabilidad de la IA o dicho de otra manera, la irresponsabilidad en el lanzamiento de soluciones de inteligencia artificial totalmente seguras y bajo control, sin comportamientos impredecibles.

Aquí podemos introducir a Microsoft y su Copilot como ejemplo. Hace un par de semanas la compañía actualizó los términos de servicio de Copilot, indicando que la herramienta está destinada a “fines de entretenimiento”, que puede cometer errores y que no debe utilizarse para tomar decisiones importantes. La advertencia tiene bastante sentido. Los modelos de IA generativa pueden equivocarse, inventar información o ofrecer respuestas incorrectas con una seguridad que no siempre está justificada.

Además, desde el punto de vista legal, añadir un aviso de este tipo funciona como una red de seguridad para evitar responsabilidades si alguien toma decisiones importantes basándose únicamente en lo que diga el sistema. Pero la advertencia es altamente sorprendente cuando Microsoft ha hecho bandera de Copilot y lo ha integrado en todos sus productos y no de entretenimiento, en la suite profesional Office y en Windows, soluciones que utilizan a diario cientos de millones de usuarios.

Es natural que la desconfianza en la IA vaya en aumento con estos casos paradójicos. Anthropic dice que MCP «debe usarse con precaución», mientras Microsoft advierte que Copilot «no debe usarse» para decisiones importantes. Y no hablamos de productos beta, sino de soluciones que se venden como el futuro de la productividad digital y se colocan en el centro de herramientas que se utilizan en entornos profesionales.

-

NoticiasHace 6 días

NoticiasHace 6 díasMistral relanza LeChat como Vibe, y le integra automatización y herramientas de código

-

NoticiasHace 6 días

NoticiasHace 6 díasAnthropic presenta Claude Opus 4.8 al tiempo que supera a OpenAI en valoración e ingresos

-

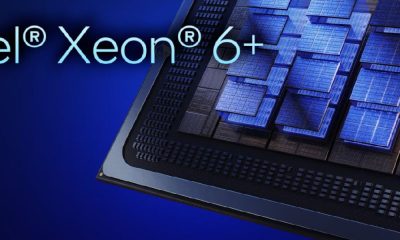

A FondoHace 2 días

A FondoHace 2 díasIntel lanza los Xeon 6+ y presenta los primeros detalles de Xeon 7

-

NoticiasHace 3 días

NoticiasHace 3 díasLa suite europea Euro-Office estará disponible el 9 de junio