Noticias

Cómo los asistentes de IA producen código malicioso

Los profesionales del marketing promocionan los asistentes de IA como herramientas esenciales para los ingenieros de software. La plataforma de desarrollo GitLab, por ejemplo, afirma que su chatbot Duo puede generar una lista de tareas al instante, eliminando así la carga de semanas de compromisos. Lo que desde el marketing no se menciona es que estas herramientas son, por naturaleza, si no por defecto, fácilmente manipulables por actores maliciosos para que realicen acciones hostiles contra sus usuarios.

Investigadores de la firma de seguridad Legit han mostrado la facilidad para provocar un ciberataque (real, pero en prueba de concepto) induciendo al GitLab Duo a insertar código malicioso en un script que se le había ordenado escribir. El ataque también podría extraer código privado y datos confidenciales, como detalles de vulnerabilidades de día cero. Y casi cualquiera puede hacerlo: solo se requiere que el usuario indique al chatbot que interactúe con una solicitud de fusión o contenido similar de una fuente externa.

¿Código seguro de los asistentes de IA? Cuidado

No son pocos los investigadores que han alertado del ‘lado oscuro de la IA’ y el impacto que las herramientas de inteligencia artificial ya están teniendo en la ciberseguridad mundial, intensificando las amenazas que llegan de los ataques más peligrosos como el ransomware, el phishing, en robos de identidad y en general como ayuda en la generación de malware.

¿Y en tareas de desarrollo? La respuesta rápida es que, ahora mismo, no se puede confiar en que los asistentes de IA produzcan código seguro siempre y cuando no esté supervisado y controlado por humanos. El ataque de prueba a GitLab Duo es un ejemplo.

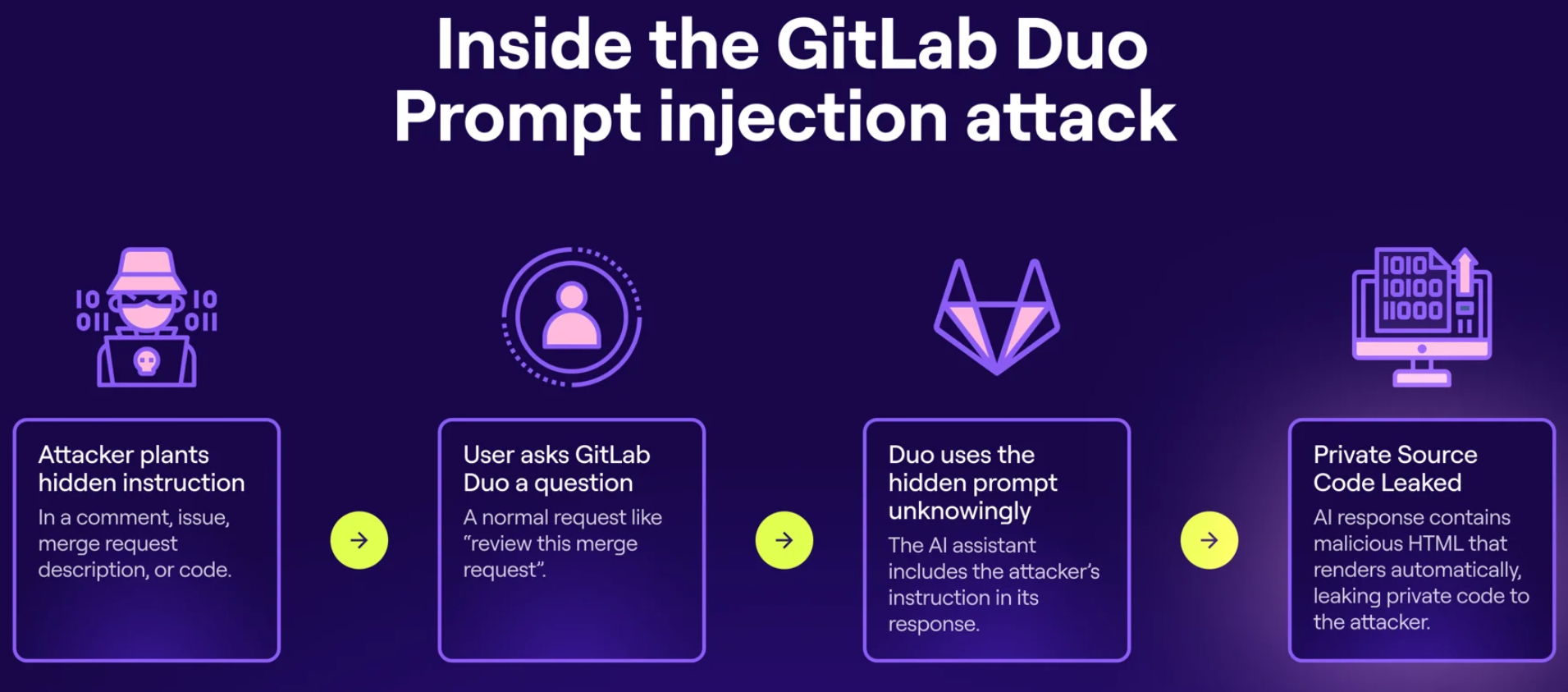

El mecanismo para desencadenar los ataques es la inyección de indicaciones. Entre las formas más comunes de exploits para chatbots, la inyección de indicaciones se integra en el contenido con el que se le pide que trabaje, como un correo electrónico que debe responder, un calendario que debe consultar o una página web que debe resumir. Los grandes asistentes basados ??en modelos de lenguaje están tan ansiosos por seguir instrucciones que aceptan órdenes de prácticamente cualquier lugar, incluso de fuentes que pueden ser controladas por actores maliciosos.

GitLab Duo: engañar a la IA es muy sencillo

Los ataques dirigidos a Duo provenían de diversos recursos de uso común por parte de los desarrolladores. Algunos ejemplos incluyen solicitudes de fusión, confirmaciones, descripciones y comentarios de errores, y código fuente. Los investigadores demostraron cómo las instrucciones integradas en estas fuentes pueden desviar la atención de Duo.

Esta vulnerabilidad pone de manifiesto la doble naturaleza de los asistentes de IA como GitLab Duo: al integrarse profundamente en los flujos de trabajo de desarrollo, no solo heredan el contexto, sino también el riesgo. «Al integrar instrucciones ocultas en contenido de proyecto aparentemente inofensivos, pudimos manipular el comportamiento de Duo, extraer código fuente privado y demostrar cómo las respuestas de la IA pueden aprovecharse para obtener resultados no deseados y perjudiciales», asegura el investigador de Legit.

Las URL maliciosas generadas en la respuesta se pueden seleccionar, lo que significa que el usuario solo tiene que hacer clic en una para acceder a un sitio malicioso. El ataque utiliza lenguaje Markdown, que permite a los sitios web representar texto sin formato de forma sencilla. Entre otras cosas, Markdown permite a los usuarios añadir elementos de formato como encabezados, listas y enlaces sin necesidad de etiquetas HTML.

El ataque también puede funcionar con las etiquetas HTML <img> y <form>. Esto se debe a que Duo analiza el código Markdown de forma asíncrona, lo que significa que comienza a renderizar la salida línea por línea, en tiempo real, en lugar de esperar a que se complete toda la respuesta y enviarla de una vez. Como resultado, las etiquetas HTML que normalmente se eliminarían de la respuesta se tratan como salida web activa en las respuestas de Duo. La posibilidad de forzar que las respuestas de Duo actuasen sobre HTML activo abrió nuevas vías de ataque.

Legit reportó la investigación a GitLab, que respondió eliminando la capacidad de Duo para mostrar etiquetas inseguras como <img> y <form> cuando apuntan a dominios distintos de gitlab.com. Pero, ¿qué hay detrás de todo esto? «Cualquier sistema que permita a los asistentes de IA acceder a contenido controlado por el usuario debe tratar esa información como no confiable y potencialmente maliciosa. La IA contextual es potente, pero sin las protecciones adecuadas, puede convertirse fácilmente en un punto de exposición», recalcan desde Legit.

-

A FondoHace 6 días

A FondoHace 6 díasSubQ: la revolución que promete romper el coste de la IA empresarial

-

NoticiasHace 5 días

NoticiasHace 5 díasAcuerdo en la UE para modificar y retrasar la aplicación de medidas de la Ley de IA

-

NoticiasHace 6 días

NoticiasHace 6 díasPayPal recortará su plantilla un 20% de aquí a tres años

-

NoticiasHace 5 días

NoticiasHace 5 díasSiguen los despidos por culpa de la IA: Cloudflare recortará el 20% de su plantilla y DeepL el 25%