A Fondo

Estudio del MIT: los agentes de IA suspenden en transparencia y seguridad

Investigadores del MIT y otras instituciones colaboradoras han publicado un informe donde analizan los 30 sistemas basados en agentes de IA más comunes. Las conclusiones del estudio («El índice de IA de 2025: documentación de las características sociotécnicas de los sistemas de IA agénticos implementados») son generalmente (hay distintos niveles) preocupantes y hablan de una IA «fuera de control» y una «pesadilla de seguridad».

La tecnología agentica se está incorporando de lleno a la corriente principal de la inteligencia artificial y el anuncio la pasada semana de la contratación por OpenAI de Peter Steinberg, el creador del marco de software de código abierto OpenClaw, refuerza la apuesta por esta funcionalidad considerada como ‘estrella’ dentro de la propia revolución que supone la inteligencia artificial.

El software OpenClaw atrajo atención no sólo por permitir capacidades salvajes (agentes que pueden, por ejemplo, enviar y recibir correo electrónico en el nombre del usuario), sino también por sus dramáticas fallos de seguridad, incluida la capacidad de secuestrar completamente las computadoras personales.

Dada la fascinación que generan los agentes y lo poco que aún se sabe sobre sus ventajas y desventajas, es importante que investigadores prestigiosos hayan analizado su funcionamiento. Y no hay buenas noticias, al menos desde el apartado de la seguridad, ya que aseguran que se trata de tecnología marcada por la falta de divulgación, la falta de transparencia y una sorprendente ausencia de protocolos básicos sobre cómo deberían operar los agentes.

Falta de transparencia en los agentes de IA

La mayor revelación del informe es la dificultad para identificar todos los problemas que podrían surgir con los agentes de IA. Esto se debe principalmente a la falta de transparencia por parte de los desarrolladores. «Identificamos limitaciones persistentes en los informes sobre características ecosistémicas y relacionadas con la seguridad de los sistemas agenticos», escribió Leon Staufer, el autor principal de un estudio en el que han trabajado investigadores del MIT, la Universidad de Cambridge, la Universidad de Washington, la Universidad de Harvard, la Universidad de Stanford, la Universidad de Pensilvania y la Universidad Hebrea de Jerusalén.

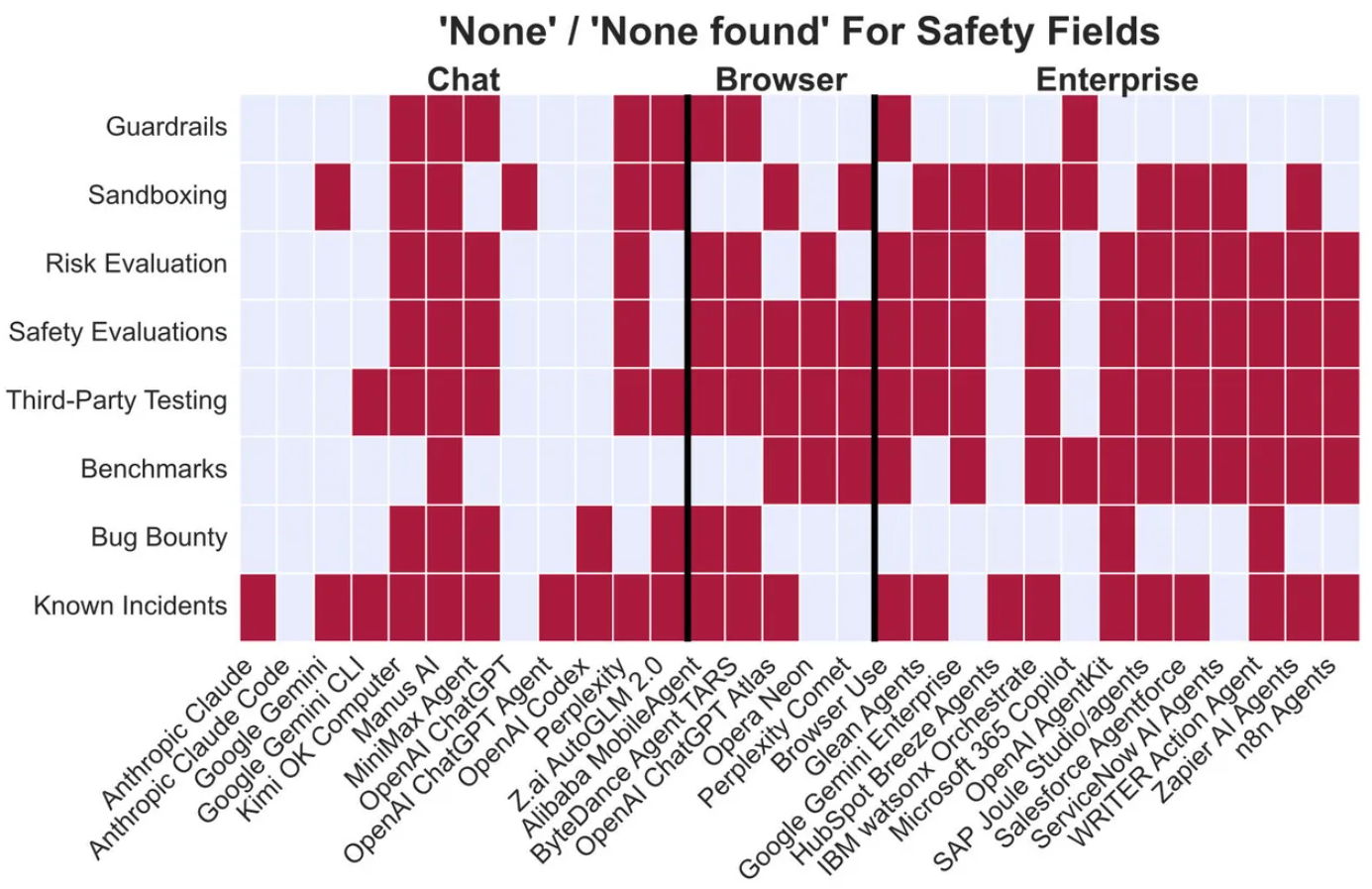

En ocho categorías diferentes de divulgación, los autores señalaron que la mayoría de los sistemas de agentes no ofrecen información alguna para la mayoría de las categorías. Las omisiones abarcan desde la falta de divulgación sobre posibles riesgos hasta la falta de divulgación sobre las pruebas realizadas por terceros, si las hubiera.

El informe está lleno de críticas sobre lo poco que se puede rastrear, seguir, monitorizar y controlar en la tecnología de IA agéntica actual. Por ejemplo, «para muchos agentes empresariales, no está claro a partir de la información disponible públicamente si existe monitoreo de rastros de ejecución individuales», lo que significa que no hay una capacidad clara para rastrear exactamente lo que está haciendo un programa de IA de agente.

«Doce de los treinta agentes no ofrecen monitorización de uso o solo notifican cuando los usuarios alcanzan el límite de velocidad», señalaron los autores. Esto significa que ni siquiera se puede controlar cuánto consume la IA de un agente de un recurso informático determinado, una preocupación clave para las empresas que deben presupuestar este tipo de recursos.

La mayoría de estos agentes tampoco indican al mundo real que son artificiales, por lo que no hay forma de saber si estás tratando con un humano o un bot. «La mayoría de los agentes no revelan su naturaleza de IA a los usuarios finales ni a terceros por defecto», señalan. En este caso, la divulgación incluiría medidas como añadir una marca de agua a un archivo de imagen generado para que quede claro cuándo se creó mediante IA, o responder al archivo «robots.txt» de un sitio web para identificar al agente como una automatización y no como un visitante humano.

Algunas de estas herramientas de software no ofrecen ninguna forma de detener la ejecución de un agente determinado. MobileAgent de Alibaba, Breeze de HubSpot, watsonx de IBM y las automatizaciones creadas por el fabricante de software alemán, n8n, «carecen de opciones de detención documentadas a pesar de la ejecución autónoma».

«Para las plataformas empresariales, a veces solo existe la opción de detener todos los agentes o retractar la implementación», señalan. Un gran problema porque descubrir que no se puede detener algo que está haciendo lo incorrecto debe ser uno de los peores escenarios posibles para una gran organización donde los resultados dañinos superan los beneficios de la automatización.

Los autores prevén que estos problemas de transparencia y control persistan entre los agentes de IA e incluso se acentúen. «Los desafíos de gobernanza documentados aquí (fragmentación del ecosistema, tensiones en la conducta de la red, ausencia de evaluaciones específicas para cada agente) cobrarán importancia a medida que aumenten las capacidades de los agentes», aseguran.

Staufer y su equipo también afirman que intentaron obtener comentarios de las empresas cuyo software se revisó durante cuatro semanas. Aproximadamente una cuarta parte de los contactados respondió, «pero solo 3 de 30 con comentarios sustanciales». Dichos comentarios se incorporaron al informe, escribieron los autores. También cuentan con un formulario proporcionado a las empresas para las correcciones en curso.

Un panorama en expansión

La inteligencia artificial agente es una rama del aprendizaje automático que ha surgido en los últimos años para mejorar las capacidades de los grandes modelos de lenguaje y los chatbots. Dependiendo de los casos de uso, la oferta de productos y el proveedor, es posible que veas diversas definiciones de agente de IA. Sin embargo, en general, podemos definirlos como una herramienta de software que puede realizar tareas de forma autónoma.

Y hay más. En lugar de simplemente asignárseles una única tarea dictada por una instrucción de texto, los agentes son programas de IA que se conectan a recursos externos, como bases de datos, y a los que se les ha otorgado una medida de «autonomía» para perseguir objetivos que van más allá del alcance de un diálogo basado en texto.

Esta autonomía puede incluir la realización de varios pasos en un flujo de trabajo corporativo, como recibir una orden de compra por correo electrónico, ingresarla en una base de datos y consultar la disponibilidad en un sistema de inventario. También se han utilizado agentes para automatizar varias etapas de la interacción con el servicio de atención al cliente, reemplazando así algunas de las consultas básicas por teléfono, correo electrónico o SMS que tradicionalmente habría gestionado un representante de atención al cliente.

Así, los autores del estudio seleccionaron la IA agéntica en tres categorías: chatbots con capacidades adicionales, como la herramienta Claude Code de Anthropic; extensiones de navegador web o navegadores dedicados a la IA, como el navegador Atlas de OpenAI; y soluciones de software empresarial como Office 365 Copilot de Microsoft. Esto es solo una muestra: otros estudios, señalaron, han abarcado cientos de soluciones tecnológicas agénticas.

Sin embargo, la mayoría de los agentes «se basan en un pequeño conjunto de modelos fronterizos de código cerrado», afirmaron Staufer y su equipo. La mayoría de estos agentes se basan en GPT de OpenAI, Claude de Anthropic y Gemini de Google.

Lo bueno y lo malo de los agentes de IA

El estudio no se basa en probar directamente las herramientas agénticas, sino en la «anotación» de la documentación proporcionada por desarrolladores y proveedores. Esto incluye «únicamente información pública de documentación, sitios web, demostraciones, artículos publicados y documentos de gobernanza», según explican. Sin embargo, se establecieron cuentas de usuario en algunos de los sistemas para verificar el funcionamiento real del software.

Los autores ofrecieron tres ejemplos que profundizan en el tema y que confirman que hay diferentes niveles de funcionamiento entre agentes de IA. Un ejemplo positivo, escribieron, es el Agente ChatGPT de OpenAI, que puede interactuar con sitios web cuando un usuario solicita en el mensaje que realice una tarea web. El Agente se distingue positivamente como el único de los sistemas de agentes analizados que proporciona un medio para rastrear el comportamiento mediante la firma criptográfica de las solicitudes del navegador.

En cambio, el navegador web Comet de Perplexity parece un desastre de seguridad. Staufer y su equipo descubrieron que el programa no cuenta con evaluaciones de seguridad específicas de cada agente, pruebas de terceros ni divulgaciones de rendimiento comparativo. Además, Perplexity no ha documentado la metodología ni los resultados de la evaluación de seguridad de Comet. Además, no se documentaron enfoques de sandboxing ni de contención más allá de las mitigaciones de inyección rápida.

El tercer ejemplo es el conjunto de agentes Breeze del proveedor de software empresarial HubSpot. Se trata de automatizaciones que pueden interactuar con sistemas de registro, como los de gestión de relaciones con los clientes. Descubrieron que las herramientas Breeze ofrecen una combinación de ventajas y desventajas. Por un lado, están certificadas para numerosas medidas de cumplimiento corporativo, como SOC2, RGPD y HIPAA.

Por otro lado, HubSpot no ofrece información sobre pruebas de seguridad. Afirma que los agentes Breeze fueron evaluados por la empresa de seguridad externa PacketLabs, «pero no proporciona metodología, resultados ni detalles de la entidad de prueba». La práctica de demostrar la aprobación del cumplimiento pero no revelar evaluaciones de seguridad reales es «típica de las plataformas empresariales», señalaron Staufer y su equipo.

Asumir responsabilidades

Lo que el informe no examina son los incidentes en la práctica, casos en los que la tecnología agéntica produjo un comportamiento inesperado o no deseado que tuvo resultados indeseables. Esto significa que aún desconocemos el impacto total de las deficiencias identificadas por los autores. Pero hay algo claro: la IA agéntica es producto de equipos de desarrollo que toman decisiones específicas. Estos agentes son herramientas creadas y distribuidas por humanos.

Por lo tanto, la responsabilidad de documentar el software, auditar los programas en busca de problemas de seguridad y proporcionar medidas de control recae directamente en los proveedores, en OpenAI, Anthropic, Google, Microsoft, Perplexity y otras organizaciones. Depende de ellas tomar las medidas necesarias para subsanar las graves deficiencias identificadas o, de lo contrario, enfrentarse a regulaciones en el futuro y también a la pérdida de confianza por incumplir las promesas, quizá excesivamente optimistas, de los agentes de IA.

* Imagen de portada generada por IA

-

EntrevistasHace 6 días

EntrevistasHace 6 días«Las líneas entre broadcast, AV corporativo e IT se están difuminando muy rápido»

-

OpiniónHace 6 días

OpiniónHace 6 díasEl riesgo interno crece en la era de la IA y exige un nuevo enfoque

-

A FondoHace 5 días

A FondoHace 5 díasMicrosoft actualiza los Surface para Empresas

-

NoticiasHace 6 días

NoticiasHace 6 díasClaude se refuerza en el entorno corporativo: agentes de IA con conexión segura y sandbox.