A Fondo

Un vistazo a las novedades clave de NVIDIA en la GTC 2023

NVIDIA presentó ayer una gran cantidad de novedades aprovechando el escenario de la GTC 2023, un evento muy importante que se ha convertido en toda una referencia en el sector tecnológico a nivel profesional.

Como la lista de novedades es muy larga, y sería contraproducente recopilarlas todas en un artículo enorme, nos vamos a centrar en los cuatro anuncios más importantes, y os los vamos a detallar para que conozcáis todas sus claves.

En líneas generales las novedades más interesantes que ha presentado NVIDIA este año se centran sobre todo en el hardware, y no se limitan al modelo tradicional sino que se extienden a la computación cuántica. Precisamente con ello abrimos este artículo, aunque no debemos olvidarnos de que el gigante verde también ha confirmado un importante impulso a la IA para poder llevarla a cualquier industria, y ha reforzado sus colaboraciones con los principales gigantes del sector.

NVIDIA DGX Quantum

Se trata del primer sistema de computación cuántica acelerado por GPU, y representa un importante punto de inflexión ya que da forma a una solución de computación de nueva generación potenciada por el súper chip Grace Hopper de NVIDIA y el modelo de programación de código abierto CUDA Quantum, unida a la plataforma de control cuántico más avanzada del mundo, OPX, de Quantum Machines.

Con este sistema es posible unir lo mejor de ambos mundos, computación clásica y computación cuántica, y esto permitirá a los investigadores contar con todo el potencial que necesitan para crear aplicaciones extraordinarias, y sin tener que renunciar a funciones avanzadas que son clave en la computación cuántica, como la calibración, el control, la corrección de errores cuánticos y los algoritmos híbridos.

A nivel de hardware, el NVIDIA DGX Quantum cuenta con un súper chip Grace Hopper, como ya hemos dicho al principio, y está conectado a través de una interfaz PCIe a un sistema Quantum Machines OPX+. Esto permite reducir la latencia a menos de un microsegundo, y permite comunicaciones casi instantáneas entre los núcleos gráficos y las unidades de procesamiento cuántico.

Cinco nuevas GPUs para portátiles profesionales

NVIDIA también ha confirmado el lanzamiento de cinco nuevas GPUs profesionales para portátiles, basadas en la arquitectura Ada Lovelace y diseñadas para dar forma a estaciones de trabajo más potentes, eficientes y ligeras. La RTX 5000 es la más potente de las cinco, ya que cuenta con 9.728 shaders, tiene 76 núcleos RT, 304 núcleos tensor, viene con 16 GB de GDDR6 sobre un bus de 256 bits y tiene un TGP configurable de entre 80 y 175 vatios.

La RTX 4000 queda un escalón por detrás con su configuración de 7.424 shaders, cuenta con 56 núcleos RT, tiene 232 núcleos tensor, dispone de 12 GB de GDDR6 sobre un bus de 192 bits y su TGP se puede configurar entre 60 y 175 vatios. La RTX 3500 encaja en la gama media-alta con sus 5.120 shaders, 40 núcleos RT y 160 núcleos tensor, tiene 12 GB de GDDR6 sobre un bus de 192 bits y su TGP se puede configurar entre los 60 y los 140 vatios.

La RTX 3000 es un modelo de gama media con 4.608 shaders, 36 núcleos RT, 144 núcleos tensor, bus de 128 bits, 8 GB de GDDR6 y un TGP configurable de 35 a 140 vatios. Finalmente tenemos la RTX 2000, que tiene 3.072 shaders, 24 núcleos RT, 96 núcleos tensor, bus de 128 bits y 8 GB de GDDR6. Su TGP se puede configurar entre los 35 y los 140 vatios. NVIDIA también ha anunciado una RTX 4000 ADA SFF para escritorio, que no es más que una versión de pequeño tamaño equipada con 6.144 shaders.

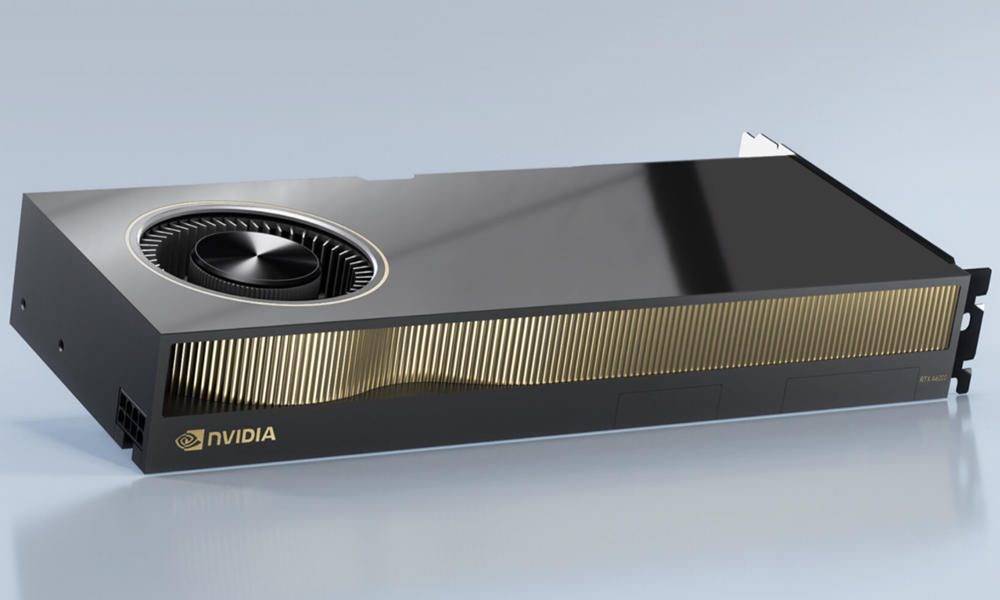

NVIDIA H100 NVL, una GPU dual especializada en Large Language Models (LLM)

El gigante verde también nos ha sorprendido con una configuración de GPU dual basada en Hopper que está diseñada específicamente para trabajar con Large Language Models (LLM), modelos de lenguaje grande en una traducción directa. Puede que a alguno no os suene y que incluso hayáis levantado una ceja, pero si os digo que Chat-GPT es uno de ellos seguro que entendéis la importancia de este nuevo hardware.

Las siglas NVL se refieren a NVLink, una tecnología de interconexión que es la que permite unir las dos GPUs que dan forma a esta aceleradora, y se utilizan un total de tres puentes Gen4. A nivel de especificaciones estamos ante una solución impresionante, ya que ofrece una potencia de hasta 68 TFLOPs en FP64, llega a los 134 TFLOPs en FP64 con sus núcleos tensor, y puede ofrecer hasta 1.979 TFLOPs en FP32 con dichos núcleos.

En FP16 la potencia con los núcleos tensor es de 3.958 TFLOPs, y en INT8 tenemos una potencia de 7.916 TFLOPs. Los números hablan por sí mismos, y sí, son verdaderamente impresionantes. La NVIDIA H100 NVL tiene un bus de 6.144 bits, cuenta con 188 GB de memoria HBM3 a 5,1 GHz y ofrece un ancho de banda de hasta 7,8 TB/s. Los modelos LLM necesitan de grandes bloques de memoria y de un gran ancho de banda, así que NVIDIA no ha dado puntada sin hilo.

-

EntrevistasHace 6 días

EntrevistasHace 6 días«Las líneas entre broadcast, AV corporativo e IT se están difuminando muy rápido»

-

OpiniónHace 6 días

OpiniónHace 6 díasEl riesgo interno crece en la era de la IA y exige un nuevo enfoque

-

A FondoHace 5 días

A FondoHace 5 díasMicrosoft actualiza los Surface para Empresas

-

NoticiasHace 6 días

NoticiasHace 6 díasClaude se refuerza en el entorno corporativo: agentes de IA con conexión segura y sandbox.