Noticias

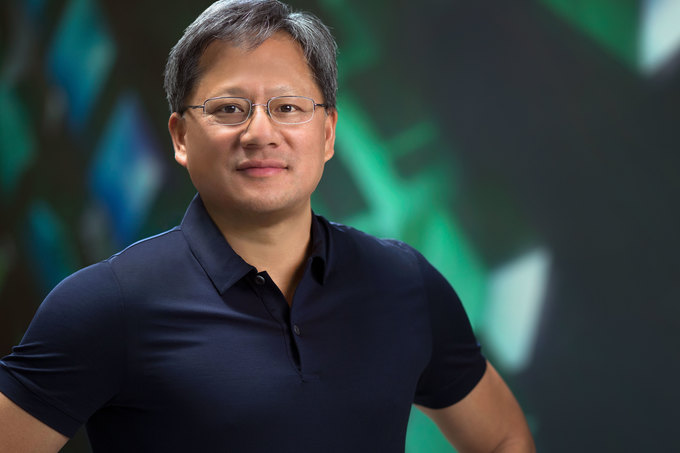

Jen-Hsun Huang, CEO de Nvidia: «El coche autónomo debe ser capaz de percibir su entorno»

Los coches autónomos son una de las áreas de la tecnología que más atrae la atención en la actualidad, tanto del público en general como de los expertos en tecnología. Son muchas las empresas que trabajan en proyectos relacionados con este tipo de vehículos, y no sólo lo hacen las dedicadas tradicionalmente al sector del automóvil. Muchas necesitan la colaboración de compañías expertas en diversos campos de la tecnología, como la robótica o la visión y la inteligencia artificial. Es el caso de Nvidia, centrada desde hace unos meses en el desarrollo de chips para los coches autónomos, así como en el de diversas aplicaciones de Inteligencia Artificial para la conducción autónoma.

Su CEO, Jen-Hsun Huang, está convencido de que para que el coche autónomo pueda avanzar debe ser capaz de percibir su entorno, es decir, lo que tiene alrededor, y hacerlo además con rapidez y precisión. De lo contrario, no será capaz de interactuar con lo que vaya encontrando en su viaje. En su opinión, la inteligencia artificial, y en concreto el Deep Learning, ha sido lo que ha permitido dotar a los vehículos de esta capacidad, hasta alcanzar niveles que podrían considerarse superhumanos.

Así se lo ha comentado Huang a Jason Anders, Editor de Negocios del Wall Street Journal, en una entrevista. Según él, la tecnología desarrollada por Nvidia permite que los coches en los que está integrada puedan reconocer los objetos mejor que el ojo humano, y además sin cansarse. Otras ventajas de este tipo de visión para él son que, a diferencia de la humana, la visión artificial nunca se cansa ni tiene emociones, por lo que una vez que se entrena al coche para utilizarla, y se prueba, lo único que sucede a partir de entonces es que mejorará con el tiempo a medida que vaya acumulando experiencia.

Huang ha descrito cómo se enseña este tipo de visión artificial que llevan integrados los coches inteligentes: «Cuando miras a lo que sucede alrededor, adivinas el punto en el que estás situado en relación a la escena, y el punto que ocupas en base a los objetos que te rodean. Acto seguido tienes que predecir dónde estará todo lo que tienes alrededor en un futuro cercano, ya sean coches, peatones, motos o bicicletas. También a dónde te diriges. En base a esa predicción, debes decidir lo que hacer de forma razonada. Podría consistir en cambiar de carril, en seguir recto o en conducir con más cuidado. También en detenerse. Hecho esto, hay que planificar la acción. Cuando conducimos, en la mayoría de los casos nos preguntamos ¿es seguro o no conducir?. Si utilizamos la lógica inversa y nos preguntásemos ¿está despejado para conducir? o ¿es seguro conducir?, podríamos enseñar a la red ese tipo de habilidad. Con eso, podríamos enseñar a un coche las habilidades necesarias para conducir y el comportamiento a seguir conduciéndose él mismo«.

-

NoticiasHace 6 días

NoticiasHace 6 díasHuawei muestra su potencial para empresas y cloud en España en el Digital Transformation Summit

-

EntrevistasHace 6 días

EntrevistasHace 6 días«El low code en sí no es una tecnología o una plataforma, es una estrategia»

-

NoticiasHace 6 días

NoticiasHace 6 díasLinux Foundation lanza Open Platform for Enterprise AI para crear herramientas de IA generativa open source

-

NoticiasHace 6 días

NoticiasHace 6 díasCinco estrategias para mejoras la experiencia del cliente que compra on-line