Noticias

Google I/O 2019: todas las novedades para desarrolladores

Además de diversas novedades para el sector del consumo, como los nuevos smartphones de gama media Pixel 3A y Pixel 3A XL (a partir de 399 euros), dar algunas pinceladas del sistema operativo Android Q y anunciar que Android está ya presente en 2.500 millones de dispositivos, Google no se ha olvidado de los desarrolladores en la primera jornada de su evento Google I/O 2019.

Así, la compañía ha anunciado también varias novedades centradas en los desarrolladores y en tecnologías como la Inteligencia Artificial o el Machine Learning. Entre ellas, el anuncio de la versión de prueba de Android Studio 3.5, con mejoras como una gestión optimizada de memoria IDE para proyectos de gran envergadura, menor latencia de escritura, optimizaciones de uso de la CPU y mejoras del editor de diseño y del emulador.

Expansión de Android Jetpack

Entre los cambios y nuevas herramientas y funciones anunciados por Google en el I/O de este año está la expansión de Android Jetpack, una colección de componentes de software de Android que ayuda a los desarrolladores a utilizar las mejores prácticas, además de liberarles de escribir código estándar y repetitivo, y de simplificar tareas complejas. La expansión de este kit incluye seis nuevas librerías de Jetpack disponibles en versión de pruebas alpha y otras cinco en beta.

Algunas de estas nuevas librerías para Jetpack incluyen CameraX, una librería open source que tiene como misión facilitar el desarrollo de funciones para la cámara en diversos dispositivos con Android. Otra de estas nuevas librerías es Jetpack Compose, que combina un modelo de programación reactivo con Kotlin, y que tiene como objetivo simplificar el desarrollo de la interfaz de usuario.

Actualmente, ya están utilizando Jetpack, anunciada el año pasado, el 80% de las 1.000 principales apps de Android. Thomas Kurian, CEO de Google Cloud, ha sido el encargado de anunciar esta y otras mejoras para desarrolladores. También han confirmado que están animando a los desarrolladores a que utilicen Kotlin, el lenguaje de programación que más rápido está creciendo, para sus desarrollos para Android. En la actualidad ya lo utilizan más de la mitad de los desarrolladores profesionales de Android.

Muchas APIs y funciones de Jetpack estarán disponibles primero para Kotlin. Además, Google está trabajando con Jetbrains y la Fundación Kotlin para ofrecer más herramientas, documentación, eventos y formación para que los desarrolladores empiecen a utilizarlo.

Flutter multiplataforma

Seis meses después del lanzamiento de Flutter 1.0, un framework de interfaz de usuario open source diseñado para el desarrollo de apps de Android y iOS, Google se ha decidido a expandirlo. Para ello ha hecho posible que además de apps, los desarrolladores puedan utilizar Flutter para desarrollar aplicaciones para la web, para equipos de sobremesa y dispositivos integrados. Todo desde una única base de código.

La compañía ha presentado su versión de prueba técnica de Flutter para la web y ha anunciado pasos para dar soporte a apps preparadas para equipos de escritorio. Por ahora, Flutter para la web no está diseñado para sustituir a las experiencias para las que está optimizado el HTML. En vez de eso, está pensado más como un sistema para desarrollar contenido rico en gráficos y con un elevado nivel de interactividad.

Por otro lado, Google ha añadido a Flutter soporte para apps de escritorio que funcionan en Windows, Mac y Linux. Además, Chrome OS está preparado para ejecutar apps creadas con Flutter. También para funcionar como plataforma de desarrollo, ya que es compatible con la ejecución de apps de Android y Linux. Así, le ha agregado paradigmas de entrada como ratón, teclado y redimensionado de ventanas. También le ha agregado herramientas para Chrome OS. Todo esto no está todavía disponible, aunque Google ya ha publicado, en GitHub, instrucciones para el desarrollo de apps con Flutter que funcionen con Mac, Windows y Linux.

El núcleo del framework móvil Flutter también va a actualizarse, y Flutter 1.5 estará disponible de inmediato. Entre sus novedades y mejoras están las actualizaciones para los nuevos requisitos del SDK para iOS de la App Store, actualizaciones de los widgets iOS y Material, soporte de motor para nuevos tipos de dispositivos y Dart 2.3. Asimismo, le ha agregado un paquete para compatibilidad para pagos dentro de las apps. Google también ofrece una API de integración para Flutter, de cara a su uso para dispositivos integrados.

14 módulos de Android OS con actualizaciones de seguridad en tiempo real

Google también anuncio un cambio importante en el sistema que utilizarán los dispositivos con Android Q para recibir actualizaciones de seguridad. Así, la compañía ha anunciado que va a hacer que varios módulos del sistema operativo, 14 en total, se actualicen de manera directa y puedan recibir actualizaciones de manera individualizada. Tan pronto como estén disponibles y sin necesidad de reiniciar el dispositivo.

Para ello, en Android Q se ha optado por un sistema distinto de desarrollo, que divide a varios componentes principales del sistema operativo en módulos del sistema independientes. Cada uno de estos módulos, a pesar de integrar un componente esencial de Android OS, funcionarán en cuando a actualizaciones de manera similar al de las apps de Android, y recibirán actualizaciones de seguridad de manera muy parecida a ellas.

Una vez que una actualización de seguridad esté disponible, la activará para todos los dispositivos compatibles con este sistema. El dispositivo detendrá entonces ese componente del sistema operativo en particular, le aplicará la actualización y reiniciará el componente sin tener que hacerlo con todo el sistema.

Este sistema hará que Android Q sea capaz de recibir actualizaciones de seguridad para 14 de sus principales componentes. Son los siguientes: ANGLE, APS, Captive portal login, Conscrypt, DNS Resolver, Documents UI, ExtServices, Media codecs, Media framework components, Network permission configuration, Networking components, Permission controller, Time zone data y Module metadata.

Eso sí, los fabricantes de dispositivos podrán decidir no utilizar esta nueva función, que tiene el nombre interno de Project Mainline. Además, sólo estará disponible en los equipos que lleven Q instalado de fábrica. Los que se hayan vendido con versiones anteriores, aunque se puedan actualizar a ella, no contarán con esta posibilidad, y seguirán con las actualizaciones de seguridad como hasta ahora: teniendo que reiniciar todo el dispositivo.

Además de esta novedad, Android Q también incluirá otras 50 funciones de seguridad y privacidad mejoradas. Entre ellas, el soporte para TLS3, randomización de direcciones MAC, más aumento del control sobre los datos de localización y una sección de configuración en la que los usuarios pueden comprobar qué apps tienen acceso a un permiso en particular, además de tener la opción de revocar el acceso de dicha app si se necesita.

Más posibilidades para el kit de Machine Learning

En otro orden de cosas, Google también ha anunciado varias actualizaciones para su plataforma de desarrollo móvil Firebase. Entre ellas destacan nuevas funciones para el SDK de Machine Learning ML Kit, que viene con APIs basadas en la nube, en el dispositivo y listas para usar. Todas con soporte para modelos personalizados. Entre las nuevas funciones, en versión de prueba, están la API On-device Translation, la API Object Detection&Tracking y AutoML Vision Edge.

Con la primera, los desarrolladores de apps pueden tener acceso a modelos offline para traducción dinámica y rápida de texto a 58 idiomas. Emplea los mismos modelos de Machine Learning que soporta Google Translate. Mientras, la segunda permite que las apps pueden localizar y rastrear, en tiempo real, el objeto que más destaque en un feed de cámara en directo.

Por último, AutoML Vision Edge permite a los desarrolladores generar modelos de clasificación de imagen personalizados. Los desarrolladores pueden subir sus datos de entrenamiento a la consola Firebase y utilizar la tecnología AutoML de Google para desarrollar un modelo personalizado de TensorFlow Lite para ejecutar en local en el dispositivo del usuario.

Otra de las actualizaciones para Firebase anunciadas es la expansión, en fase de prueba, de la Monitorización del rendimiento de Firebase a las apps web. También se ha presentado un constructor de audiencia en Google Analytics para Firebase, así como un emulador de Funciones Cloud. Además, se ha mejorado el Firebase Test Lab y se han añadido alertas de velocidad configurables a Firebase Crashlytics.

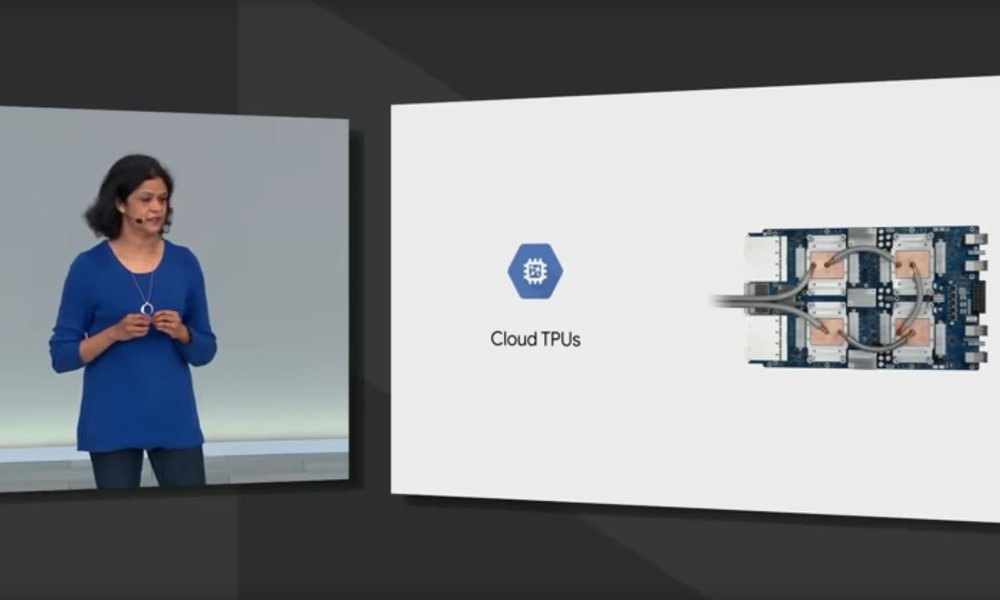

Pods TPU Cloud ya disponibles

Google también ha anunciado que sus pods TPUs Cloud v2 y v3 ya están disponibles públicamente, también en fase de pruebas. Con ellos, los investigadores e ingenieros que trabajan con Machine Learning pueden realizar iteraciones con más rapidez, y entrenar modelos de Machine Learning con más capacidad.

Los pods están compuestos de racks de Unidades de proceso Tensor (TPUs), los chips de silicio personalizado que lanzó Google en 2016. Juntos, en formato multi-rack, componen una «supercomputadora escalable para machine learning«, según Google.

Un solo pod TPU Cloud pueden integrar más de un millar de chips TPU. Están conectados por una red de malla toroidal bidimensional, que el software de pila de la TPU emplea para programar varios racks de máquinas como si fuesen una sola, lo que hace a través de varias APIs de alto nivel.

Los Pods TPU Cloud v3, de última generación, cuentan además con refrigeración líquida, con el objetivo de permitir que alcancen el máximo rendimiento posible. Cada uno cuenta con más de 100 petaflops de potencia de computación. Gracias a esto, los Pods pueden tardar desde unos minutos a unas pocas horas en completar cargas de trabajo de Machine Learning que llevaría días o semanas completar en otros sistemas.

TCAV, para combatir el sesgo en Inteligencia Artificial

En Google están también trabajando para que sus modelos de Machine Learning e Inteligencia Artificial sean más transparentes, como medida para evitar el sesgo. Para ello están haciendo varias mejoras, de las que la principal es el uso de una tecnología llamada TCAV. Se trata de un método de interpretación encargado de comprender que señales utilizan los modelos de redes neuronales para elaborar una predicción.

En teoría, la capacidad de la tecnología para comprender las señales podría sacar a la superficie el sesgo, porque destacaría si los hombres son una señal sobre las mujeres. También desvelaría otros sesgos de raza, ingresos y ubicación. Con esta tecnología, los investigadores podrán ver cómo se valoran los conceptos importantes.

No se necesitan volver a entrenar con modelos a TCAV para utilizarla. Su puesta en marcha es un esfuerzo para diseccionar modelos e ilustrar por qué toma un modelo una decisión concreta. En su desarrollo trabaja el equipo de Inteligencia Artificial de Google, y su finalidad es permitir a los modelos utilizar conceptos más elevados, así como ilustrar las variables en las que se basa un modelo.

-

A FondoHace 7 días

A FondoHace 7 díasMicrosoft actualiza los Surface para Empresas

-

EntrevistasHace 6 días

EntrevistasHace 6 días«Nuestro propósito es actuar como un habilitador ciberseguro de las operaciones»

-

NoticiasHace 6 días

NoticiasHace 6 díasNVIDIA sigue batiendo récords gracias a la IA

-

NoticiasHace 6 días

NoticiasHace 6 díasDigital Realty abre su primer centro de datos en Barcelona