Noticias

Acuerdo pionero para construir una IA segura por diseño

Mientras Europa sigue trabajando en la configuración de la primera regulación sobre IA, la conocida como AI Act, aunque carece de consenso entre los estados miembros, un grupo de 18 países se han unido para comprometerse en definir una batería de medidas para que la IA sea segura por diseño.

Para la Agencia de Seguridad de Infraestructura y Ciberseguridad de EEUU (CISA), se trata de un primer paso muy importante. Y es que el hecho de ver cómo países de la talla de EEUU y Gran Bretaña se unen en un acuerdo internacional, supone un antes y un después en el deseo por mantener la IA a salvo de actores deshonestos y de establecer una política común entre las empresas.

Jen Easterly, directora de CISA, asegura que es muy importante que los países reconozcan la prioridad de la seguridad en el desarrollo de la IA. Así pues, la privacidad y la seguridad se imponen por primera vez a otras cuestiones como la inmediatez o la reducción de costes para triunfar en el mercado frente a otros modelos.

Junto a los dos países citados con anterioridad, se han sumado además: Alemania, Italia, República Checa, Estonia, Polonia, Australia, Chile, Israel, Nigeria y Singapur.

Las claves de la nueva regulación

Con anterioridad, el presidente Biden firmó una orden ejecutiva para exigir a las empresas de IA a realizar pruebas de seguridad, privándolas de hackers. El nuevo documento está conformado por 20 páginas, siendo su objetivo establecer las directrices internacionales oportunas que detallen la creación y el uso seguro de los sistemas de IA. Para ello, las empresas deberán garantizar la seguridad tanto de los usuarios como del público en general.

Se insta a establecer monitorización para detectar abusos, fijar una protección de datos contra manipulaciones y evaluar a los proveedores de software. También contempla recomendaciones para publicar modelos tras la realización de pruebas de seguridad exhaustivas.00

Con el proyecto de IA segura por diseño podrían frenarse aspectos clave de la sociedad actual como la manipulación electoral o la pérdida de empleos. Con un equilibrio adecuado y consensuado se conseguirá poner freno a la brecha de seguridad.

La postura de Europa

Pese a que el viejo continente ha tomado ventaja en su deseo por crear leyes regulativas de los sistemas de IA, así como que las empresas realicen pruebas de seguridad periódicas frente a posibles vulnerabilidades, la última reunión técnica del Consejo Europeo, la Comisión Europea y el Parlamento Europeo generó discrepancias.

El pasado 10 de noviembre no se llegó a un acuerdo, de ahí que Alemania, Francia e Italia rechazasen públicamente la regulación de los sistemas de IAG, contrastando los últimos acuerdos alcanzados por los estados miembros de la UE.

Los tres países han firmado un acuerdo provisional propio que implique la autorregulación obligatoria mediante códigos de conducta para los modelos básicos de IA. No obstante, se oponen a las normas no probadas. Apuestan porque inicialmente no se impongan sanciones, solo si después de un cierto periodo se detectan y mantienen violaciones del código de conducta.

En este sentido, el Ministerio de Economía de Alemania, que lleva las riendas de este aspecto junto al Ministerio de Asuntos Digitales, ha asegurado que las leyes y el control estatal no deben regular la IA, sino su aplicación. Para estos tres países, hay que regular las aplicaciones de la IA, pero nunca la propia tecnología.

La secretaria de Estado de Asuntos Económicos, Franziska Brantner, apuesta por aprovechar las oportunidades y limitar los riesgos, fijando un equilibrio entre lo tecnológico y lo legal. Ya en noviembre, Gran Bretaña organizó su primera cumbre sobre seguridad de la IA.

El uso de la IA por Apple

La compañía ha incorporado nuevas funciones de IA en sus productos, especialmente en el área de fotografía del iPhone. Con su nuevo chatbot, Apple GPT, se pretende utilizarlo dentro de la empresa y aprovechar las funciones de IAG para el desarrollo de software sin comprometer la seguridad del producto. No obstante, aún no ha llegado a sus clientes.

La otra cara de la moneda

Digital Europe, un grupo de defensa que representa a las industrias digitales del viejo continente, ha publicado una declaración previa a las negociaciones de la innovadora Ley de Inteligencia Artificial (IA). Aseguran que un exceso de regulación podría derivar en una obstaculización de la innovación y que muchas empresas abandonasen Europa.

Además, aseguran que la carga financiera podría suponer para las empresas que quieran llevar al mercado productos basados en IA la necesidad de operar fuera de la UE, por lo que generaría una gran desigualdad económica para las pequeñas empresas. Se estima que cuando la Ley de IA se apruebe, generará sanciones por incumplimiento de hasta 20 millones de euros o del 4% de la facturación mundial.

-

A FondoHace 6 días

A FondoHace 6 díasLa UE presenta por fin sus planes para despegar en soberanía tecnológica

-

NoticiasHace 7 días

NoticiasHace 7 díasMicrosoft presenta un equipo de escritorio para desarrolladores de IA: Surface RTX Spark Dev Box

-

NoticiasHace 7 días

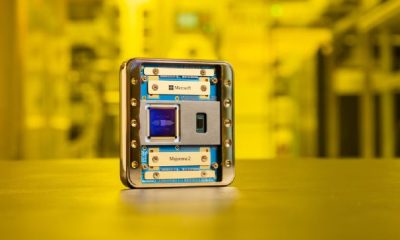

NoticiasHace 7 díasMicrosoft anuncia el chip cuántico Majorana 2 y promete máquinas funcionales en 2029

-

A FondoHace 5 días

A FondoHace 5 díasCinco grandes novedades de Microsoft en la Build 2026