A Fondo

Salesforce y cómo solo la confianza evitará un nuevo AI Winter

Tan solo en contadas ocasiones, la historia de la tecnología transmite esa sensación de estar viviendo un momento especial, transformador. La llegada y sobre todo la popularización de Internet sea probablemente el más destacado de las últimas décadas y tal vez, si la industria se mantiene a la altura de las expectativas que está creando, el desarrollo de la Inteligencia Artificial también lo sea.

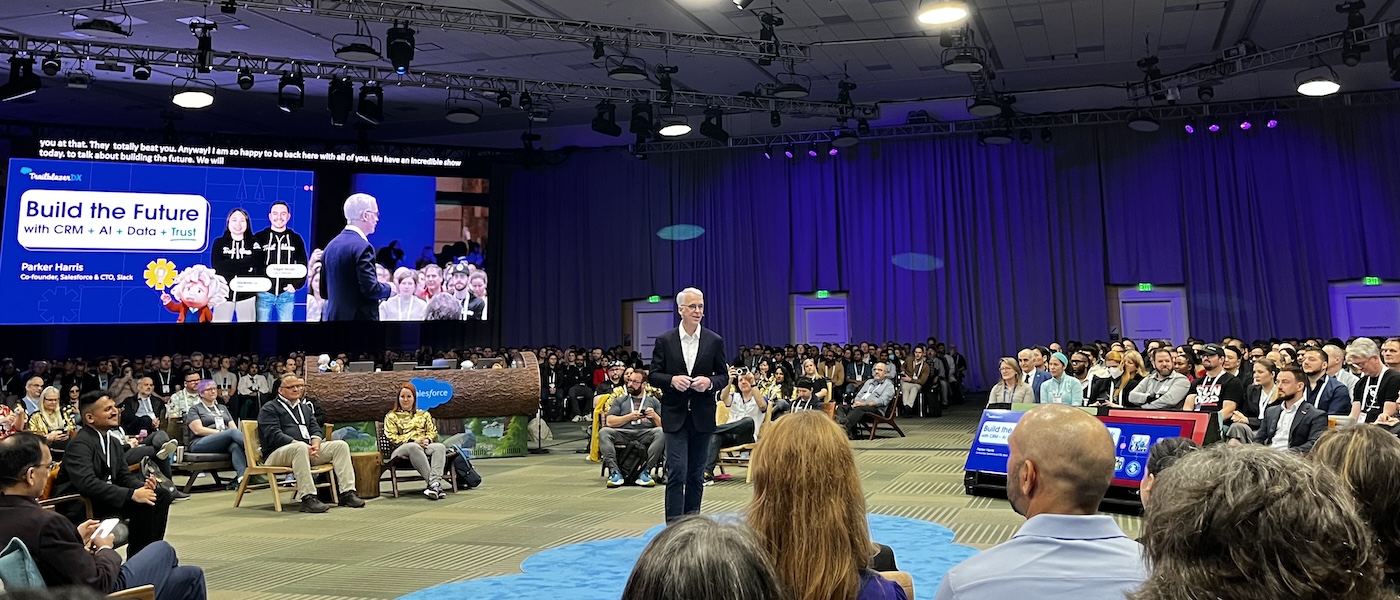

En este sentido Silvio Saravese, Chief Scientist de Salesforce, y al que hemos tenido la oportunidad de escuchar en la conferencia para desarrolladores (TrailbalzerDX) que estos días la compañía está celebrando en San Francisco, intentaba si no rebajar, sí ser realista sobre el estado actual en el que nos encontramos: «en la historia de la IA, hemos pasado ya unos cuantos ‘AI-Winters’» explicaba, refiriéndose al hecho de que «en ocasiones hemos creado expectativas que no eran realistas, porque la tecnología no estaba realmente preparada para ofrecer lo que prometía, o simplemente sus posibilidades no eran apasionantes».

Por supuesto, ahora todo es diferente. El vendaval generado por OpenAI y otros modelos ha supuesto un antes y un después en la forma en la que los consumidores se relacionan con la búsqueda y sobre todo creación de nuevos contenidos… y este hype, ha comenzado a permear (aunque tal vez más lentamente) el mundo de las empresas.

«En esta ocasión», asegura Saravese , «no tengo dudas de que la tecnología es la adecuada», pero advierte que aún así, todo podría perderse (y por lo tanto afrontar una nuevo invierno para la inteligencia artificial) si las compañías del sector no son capaces de ofrecer las máximas garantías en algo que es mucho más intangible que los chips, los LLM o las GPUs: la confianza.

Paula Goldman, Chief Ethical Officer de Salesforce, ahondaba en esta idea al comentar cómo temas como la seguridad y privacidad de los datos, la necesaria formación y el re-skilling de los empleados pero sobre todo que la compañía pueda efectivamente confiar (¿ciegamente?) en la calidad de la IA son las principales cuestiones que emergen cuando los CIOs se plantean la posibilidad de poner en marcha proyectos de inteligencia artificial generativa.

¿Cómo se construye esta confianza? No solo por supuesto, limitando al máximo la tendencia a «alucinar» que tienen estos modelos, sino aplicando principios de completa transparencia en el desarrollo de los prompts, en entender cómo funcionan los modelos, que puedan ser auto-explicativos (por qué respondo qué) y que cuando estas condiciones no se cumplan, las compañías tengan la posibilidad editarlos de una forma sencilla (con poco más que unos clics), de modo que en un proceso de iteración y refinamiento continuo, se maximice el valor que la IA entrega a las empresas y a sus clientes.

En el caso de Salesforce, esta visión ha cristalizado en el desarrollo de su Salesforce Copilot y, muy especialmente, en su «Einstein 1 Studio«, un conjunto de herramientas low-code que facilitan que administradores de sistemas y programadores puedan integrar capacidades IA en cualquier implementación CRM. Que puedan hacerlo con seguridad (en una «Trust Layer» que asegura que los datos de la empresa están protegidos), sin barreras (a través de una Data Cloud que facilita romper con cualquier silo en el que la empresa almacene sus datos, como pueden ser data-lakes externos) y, como indicábamos antes, con capacidad para no solo construir el modelo, sino refinarlo y mejorarlo de forma continua sin necesidad de ser expertos informáticos, gracias en este caso a herramientas como Prompt Builder o Model Builder.

Para Salesforce, como para la mayoría de las empresas que se encuentran desarrollando nuevas soluciones en este terreno, este es un primer pero decisivo paso. Un paso en el que no solo las compañías tecnológicas, sino sobre todo los desarrolladores tienen mucho que decir.

Porque si se crea esa confianza entonces, tal y como asegura Saravese, el escenario cambia: el programador deja de realizar tareas repetitivas y se centra en las de valor; e incluso pasa de elaborar el código, a ser un orquestador de soluciones que se alinean de forma efectiva con las necesidades del negocio. Es probable que todas estas promesas no se cumplan a corto plazo; que haya reveses e incluso que nos asomemos al precipicio de ese invierno, pero como la cuestión permanece: no se trata tanto de si la IA va a convertirse en la gran revolución de nuestro tiempo, sino de cuándo lo hará.

-

EntrevistasHace 6 días

EntrevistasHace 6 días«Las líneas entre broadcast, AV corporativo e IT se están difuminando muy rápido»

-

OpiniónHace 6 días

OpiniónHace 6 díasEl riesgo interno crece en la era de la IA y exige un nuevo enfoque

-

A FondoHace 5 días

A FondoHace 5 díasMicrosoft actualiza los Surface para Empresas

-

NoticiasHace 6 días

NoticiasHace 6 díasClaude se refuerza en el entorno corporativo: agentes de IA con conexión segura y sandbox.